Integrieren Sie Sicherheit in Ihren Code, um Cyber-Risiken zu minimieren

Integrieren Sie Sicherheit in Ihren Code, um Cyber-Risiken zu minimieren

Verringern Sie das Risiko, indem Sie über die Entwicklerschulung hinausgehen und ein Sicherheitsdenken in den gesamten Entwicklungsprozess mit relevantem, praktischem Lernen einbetten.

Upskill auf sichere Entwicklung in der neuen Welt der KI

Secure Code Warrior unterstützt Unternehmen bei der Umstellung auf KI-gestützte Entwicklungspraktiken mit äußerst relevanten Weiterbildungsinitiativen, die darauf ausgelegt sind, Lücken zu schließen, die von mangelndem Bewusstsein für die Arbeit mit KI und LLMs über übermäßiges Vertrauen in die Sicherheit von KI-generiertem Code bis hin zum Auftreten neuer Schwachstellen im Zusammenhang mit der KI-Codierung reichen.

Erhalten Sie erstklassige Inhalte zu KI/LLM-Themen für verschiedene Rollen im gesamten SDLC, um Risiken zu minimieren. Von Entwicklern und Qualitätssicherung bis hin zu Architekten und Produktmanagern – wir haben alles für Sie.

Sichere Software-Entwicklung der nächsten Generation

Risikominimierung in einer Welt der KI + Entwickler

Da immer mehr Codezeilen in immer kürzerer Zeit und mit immer weniger Aufwand produziert werden, steigt das Risiko von versteckten Fehlern, Sicherheitslücken und technischen Schulden exponentiell an. Dieser Wandel macht Code-Reviews, Tests und sichere Codierungspraktiken wichtiger denn je, um sicherzustellen, dass die Geschwindigkeit nicht auf Kosten der Zuverlässigkeit und Sicherheit geht. Die Weiterbildung von Entwicklern ist der erste Schritt zu besseren Ergebnissen in einer Umgebung, in der Tools wie Github Copilot, Cursor AI, Amazon Q Developer und andere zum Einsatz kommen, und unterstreicht die Notwendigkeit einer kontinuierlichen Betonung der sicheren Code-Ausbildung.

Inhalt der Learning Platform erkunden

Verwaltung von KI-Risiken durch Beobachtbarkeit und Governance

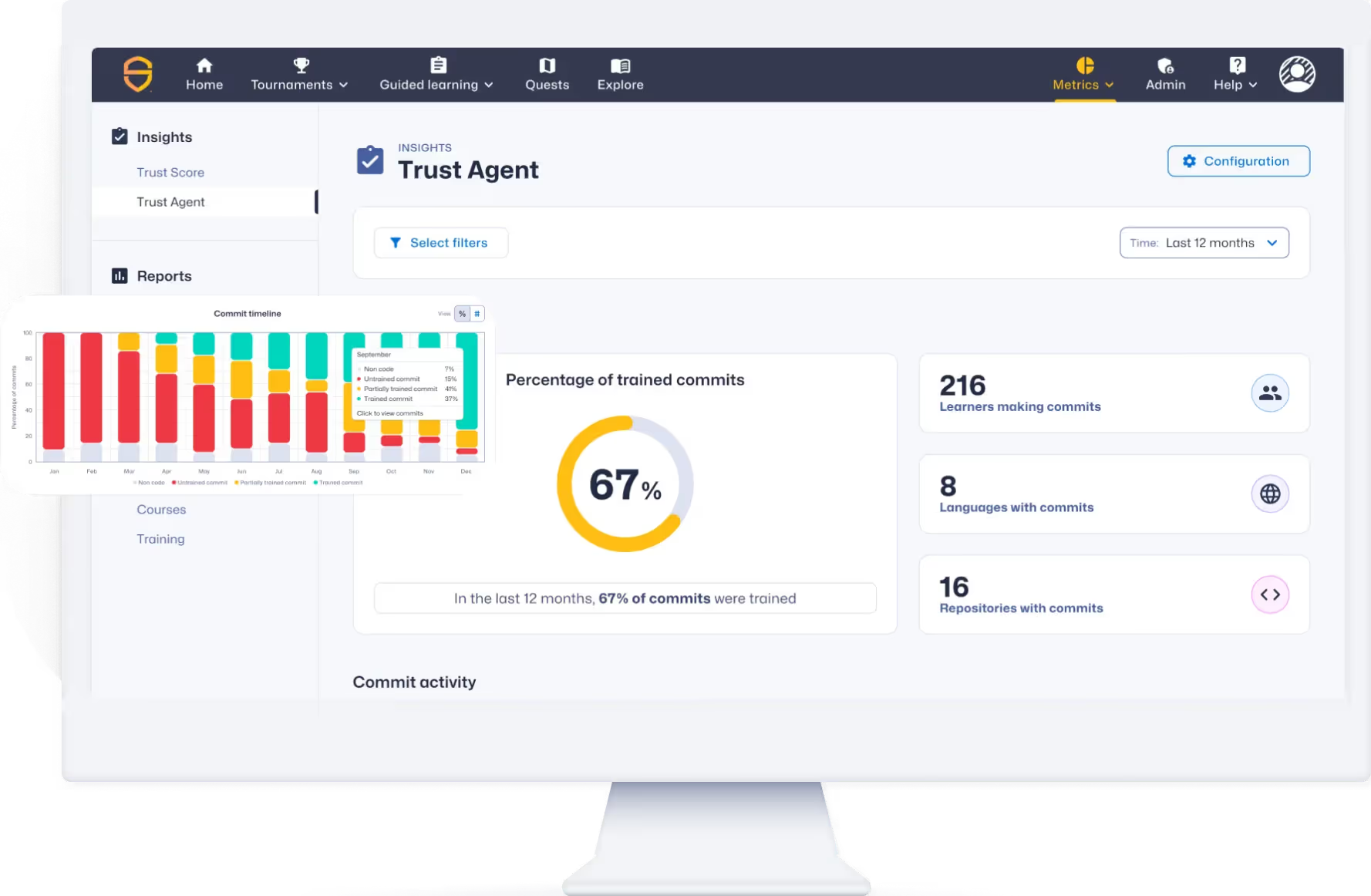

Qualifikationsinitiativen sind nur der erste Schritt, um sicherzustellen, dass Sie zusätzliche Risiken, die durch KI-gestützte Kodierung entstehen, angehen. Mit SCW Trust Agent™ erhalten Sie Einblick in die Entwickler, die mit Ihrer Codebasis arbeiten, und in deren Sicherheitsfähigkeiten. Sie können dann Richtlinien für Code-Repositories konfigurieren, um Ihre Sicherheitslage durch proaktive Governance zu verbessern.

SCW Trust Agent erkundenMessbare Auswirkungen über die Einhaltung der Vorschriften hinaus

Unternehmen, die einen proaktiven Ansatz für Best Practices für sicheren Code verfolgen, der über die Einhaltung von Vorschriften hinausgeht, erzielen greifbare Geschäftsergebnisse. Denn die kosteneffizienteste Art, Schwachstellen zu beseitigen, ist, sie von vornherein zu verhindern. Der SCW Trust Score™ bietet Unternehmen eine Möglichkeit, den Fortschritt der Sicherheitskompetenzen von Entwicklern im Laufe der Zeit zu messen und zu bewerten, was insbesondere im Hinblick auf die frühe Einführung von KI-gesteuerten Programmierumgebungen wichtig ist.

SCW Trust Score erkunden

Sicherere KI-Codegenerierung mit kostenlosen Sicherheitsregeln

KI-Codierungstools sind schnell, aber nicht immer sicher. Secure Code Warrior Die kostenlosen KI-Sicherheitsregeln von bieten einfache, leichtgewichtige Schutzmaßnahmen, die Tools wie Copilot und Cursor helfen, standardmäßig sichereren Code zu generieren. Einfach zu übernehmen, zu erweitern und in Ihre Konfiguration einzufügen – kein SCW-Konto erforderlich.

Entdecken Sie die KI-SicherheitsregelnVerbesserung der Produktivität, aber Erhöhung des Risikos

Der weit verbreitete Einsatz von KI-Codierungstools stellt eine neue Herausforderung dar: fehlende Transparenz und Kontrolle über den von KI erzeugten Code.

78%

- StackOverflow

30%

- arXiv

50%

- BaxBench

Die Vorteile von Trust Agent: AI

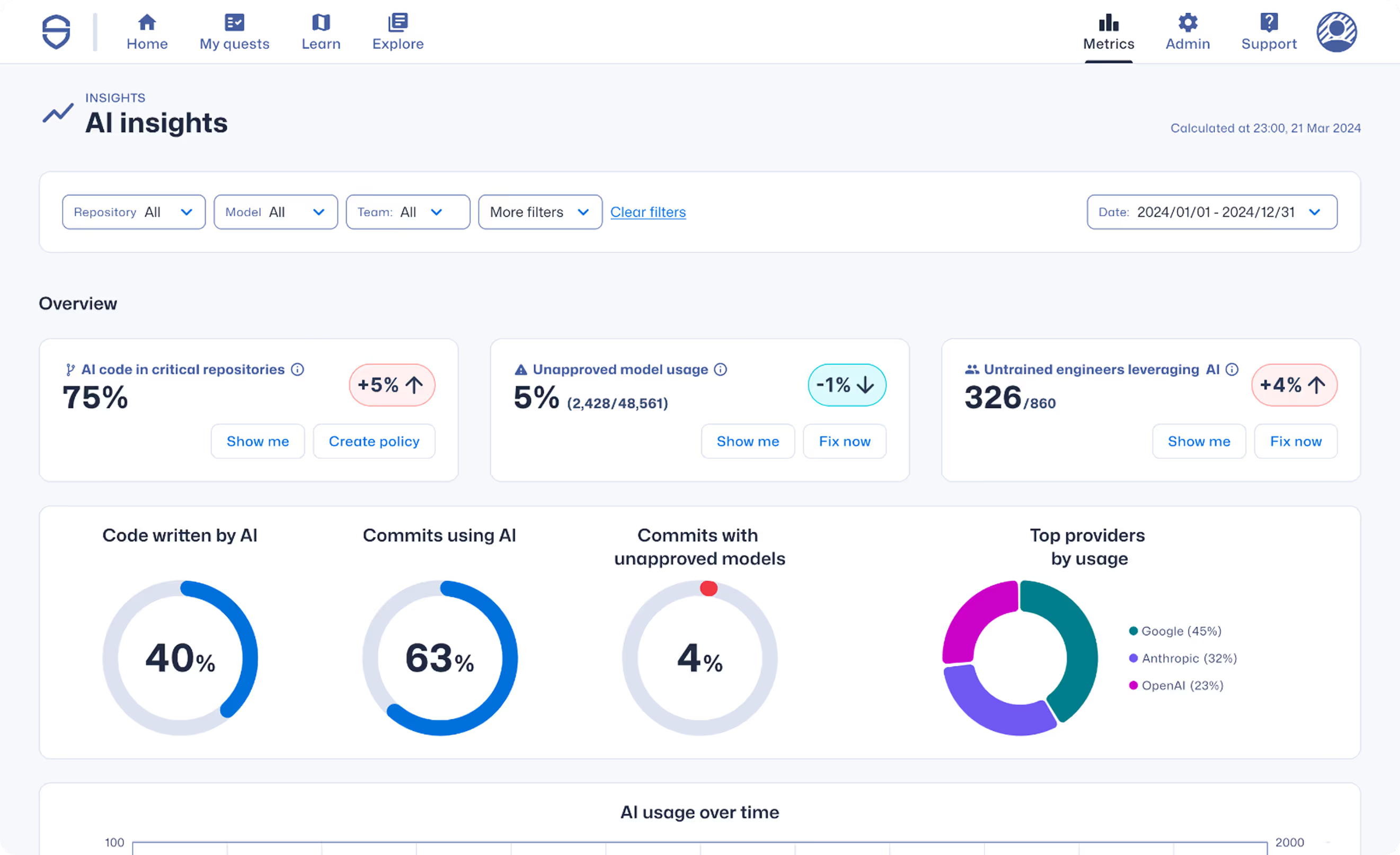

Die neuen KI-Funktionen von SCW Trust Agent bieten Ihnen die umfassende Beobachtungsmöglichkeit und Kontrolle, die Sie benötigen, um die Einführung von KI in Ihrem sicheren Softwareentwicklungszyklus (SDLC) ohne Sicherheitseinbußen zu verwalten.

Die Herausforderung von AI in Ihrem SDLC

Ohne eine Möglichkeit, die KI-Nutzung zu verwalten, sind CISOs, AppSec und technische Leiter neuen Risiken und Fragen ausgesetzt, die sie nicht beantworten können. Zu den Bedenken gehören unter anderem: Mangelnder Überblick darüber, welche Entwickler welche nicht genehmigten Modelle verwenden; Ungewissheit über die Sicherheitskompetenz von Entwicklern, die KI verwenden. Keine Erkenntnisse darüber, wie viel Prozent des beigesteuerten Codes KI-generiert ist. Unfähigkeit, Richtlinien und Governance durchzusetzen, um das Risiko von KI-Tools zu verwalten.

- Mangelnder Überblick darüber, welche Entwickler welche nicht genehmigten Modelle verwenden.

- Ungewissheit über die Sicherheitskompetenz von Entwicklern, die KI einsetzen.

- Keine Erkenntnisse darüber, wie viel Prozent der Beiträge KI-generiert sind

- Unfähigkeit, Richtlinien und Governance durchzusetzen, um das Risiko von KI-Tools zu verwalten.

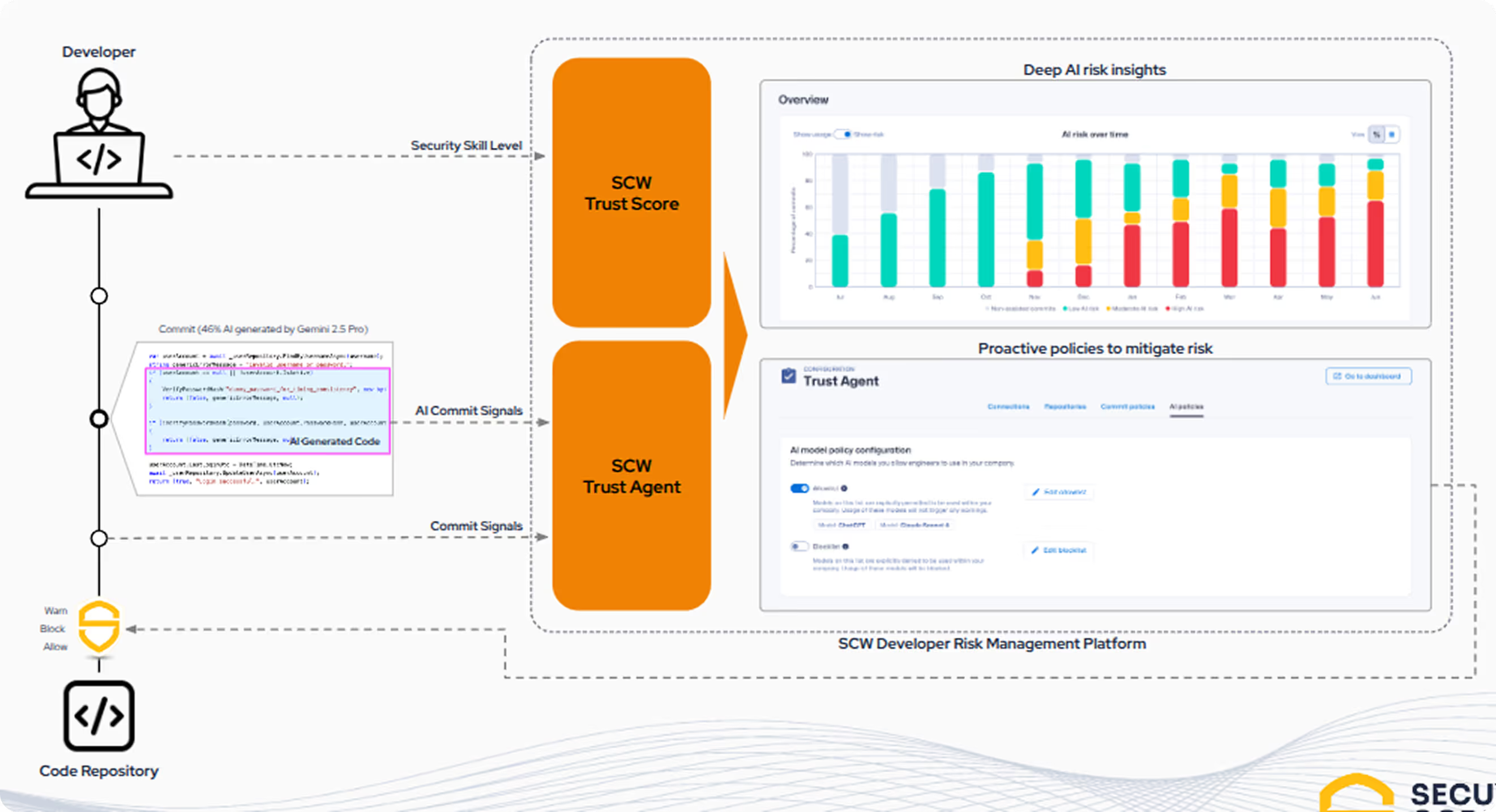

Einzigartige Kombination von Signalen

SCW versetzt Unternehmen in die Lage, die Geschwindigkeit der KI-gestützten Entwicklung zu nutzen, ohne die Sicherheit zu beeinträchtigen. AI Signals ist die erste Lösung, die Transparenz und Governance bietet, indem sie eine einzigartige Kombination aus drei Schlüsselsignalen korreliert, um das KI-gestützte Entwicklerrisiko auf Commit-Ebene zu verstehen.

- Nutzung von KI-Codierungswerkzeugen: Einblicke, wer welche KI-Tools verwendet, welche LLM-Modelle auf welchen Codebasen.

- Erfasst in Echtzeit: Trust Agent: KI fängt KI-generierten Code auf dem Computer und der IDE des Entwicklers ab.

- Sichere Kodierungsfähigkeiten der Entwickler: Wir bieten ein klares Verständnis der sicheren Programmierfähigkeiten eines Entwicklers, die die Grundlage für einen verantwortungsvollen Umgang mit KI bilden.

Sichtbarkeit der AI-Nutzung

Verschaffen Sie sich einen umfassenden Überblick über KI-Codierassistenten und -agenten sowie über die LLMs, die sie antreiben. Entdecken Sie nicht zugelassene Tools und Modelle. Keine "Schatten-KI" mehr.

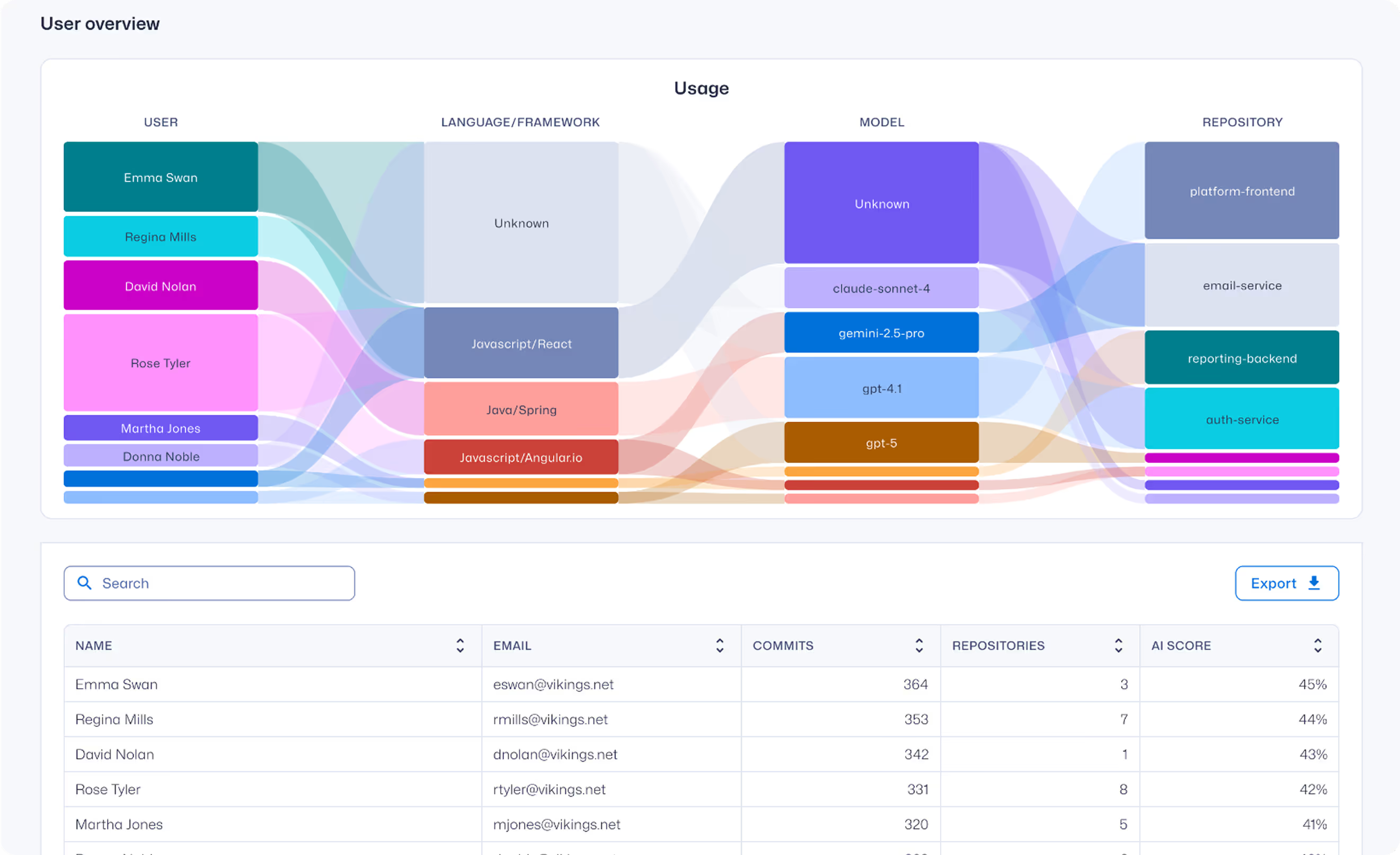

Beobachtbarkeit von KI-gestützten Übertragungen nach Entwickler und Codebasis

Verschaffen Sie sich einen tiefen Einblick in die KI-gestützte Softwareentwicklung, einschließlich der Frage, welche Entwickler welche LLM-Modelle für welche Codebasen verwenden.

Integrierte Governance und Kontrolle

Verknüpfen Sie KI-generierten Code mit tatsächlichen Übertragungen, um das tatsächliche Sicherheitsrisiko zu verstehen, das eingeführt wird. Automatisieren Sie die Durchsetzung von Richtlinien, um sicherzustellen, dass KI-gestützte Entwickler sichere Codierungsstandards erfüllen, bevor ihre Beiträge akzeptiert werden.

Entdecken Sie AI Insights

Vertrauensagent: AI verschafft Unternehmen einen Überblick über die Risiken, die Entwickler mit LLM-gestützten, Code-generierenden Tools eingehen. Die Lösung tut dies in drei Schritten:

- Inspektion von AI-generiertem Code-Verkehr: Vertrauens-Agent: AI wird als einfaches IDE-Plugin oder Endpunkt-Agent eingesetzt, der den von AI-Coding-Tools wie GitHub Copilot, ChatGPT, Google Gemini oder Cursor generierten Code abfängt und überwacht.

- Anreicherung mit dem Qualifikationsniveau der Entwickler: Der letzte Schritt besteht darin, diese Daten mit den sicheren Codierungskenntnissen des beitragenden Entwicklers anzureichern, die mit dem branchenführenden Produkt Secure Code Learning von SCW gemessen werden.

Durch die Korrelation dieser Schlüsselsignale liefert Trust Agent: AI liefert den Sicherheits- und Entwicklungsteams verwertbare Informationen, einschließlich der nicht genehmigten Verwendung von LLM-Modellen und der Identifizierung von Entwicklern mit begrenzten Kenntnissen in sicherer Programmierung, die KI-generierten Code einbringen.

Verstehen Sie das Risikoprofil Ihres Unternehmens

Jede Datenschutzverletzung kann den Ruf Ihrer Marke schädigen und dazu führen, dass Ihr Unternehmen Aufträge verliert oder Geldstrafen zahlen muss. Wussten Sie, dass 67 % der Entwickler zugeben, wissentlich Code mit Sicherheitslücken zu versenden? Secure Code WarriorMit der Plattform für Sicherheitsschulungen für Entwickler können Sie die Fähigkeiten von Entwicklern im Bereich der sicheren Programmierung bewerten und maßgeschneiderte Schulungsprogramme erstellen, um das Risikoprofil Ihres Unternehmens zu minimieren.

Wie Secure Code Warrior Ihnen dabei hilft, Cybersicherheitsrisiken zu mindern

Verringerung des Risikos durch qualifizierte Entwickler

- Über 75 Programmiersprachen und Frameworks

- Praxisnahes Lernen

- Über 11.000 Lernaktivitäten

Die Konzentration auf eine sichere Entwicklung wird ebenfalls dazu beitragen:

Kosten reduzieren

Steigerung der Produktivität

Konformität erreichen

Reduzieren Sie Risiken durch umfassende Transparenz und Kontrollen

- Anpassbare Richtlinienkontrollen

- Umfassende Unterstützung von Code-Repositories

- Verwertbare Erkenntnisse über Repos, Sprachen und Entwickler hinweg

Zusätzliche Secure Code Warrior

Ressourcen auf AI Insights

OWASP Top 10 für LLM-Bewerbungen: Was ist neu, was hat sich geändert, und wie bleibt man sicher?

Bleiben Sie bei der Absicherung von LLM-Anwendungen mit den neuesten OWASP Top 10 Updates immer einen Schritt voraus. Entdecken Sie, was neu ist, was sich geändert hat und wie Secure Code Warrior Sie mit aktuellen Lernressourcen ausstattet, um Risiken in der generativen KI zu minimieren.

Warum Entwickler Sicherheitskenntnisse benötigen, um KI-Entwicklungstools effektiv nutzen zu können

Das Versprechen, dass künstliche Intelligenz auf Knopfdruck komplexen Code schreibt, ist faszinierend, aber die Realität ist, dass die KI viel Hilfe von menschlichen Entwicklern benötigt, um wirklich sicheren und zuverlässigen Code zu erstellen.

LLMs: Ein (un)perfekter menschlicher Ansatz zur sicheren Kodierung?

Auch wenn es unvermeidlich scheint, dass die KI-Technologie im Stil des LLM die Art und Weise, wie wir an viele Aspekte der Arbeit herangehen - nicht nur an die Softwareentwicklung - verändern wird, müssen wir einen Schritt zurücktreten und die Risiken jenseits der Schlagzeilen betrachten. Und als KI-Begleiter sind ihre Schwächen vielleicht ihr "menschlichstes" Attribut.

Zusätzliche Secure Code Warrior zu AI & LLMs

OWASP Top 10 für LLM-Bewerbungen: Was ist neu, was hat sich geändert, und wie bleibt man sicher?

Bleiben Sie bei der Absicherung von LLM-Anwendungen mit den neuesten OWASP Top 10 Updates immer einen Schritt voraus. Entdecken Sie, was neu ist, was sich geändert hat und wie Secure Code Warrior Sie mit aktuellen Lernressourcen ausstattet, um Risiken in der generativen KI zu minimieren.

Warum Entwickler Sicherheitskenntnisse benötigen, um KI-Entwicklungstools effektiv nutzen zu können

Das Versprechen, dass künstliche Intelligenz auf Knopfdruck komplexen Code schreibt, ist faszinierend, aber die Realität ist, dass die KI viel Hilfe von menschlichen Entwicklern benötigt, um wirklich sicheren und zuverlässigen Code zu erstellen.

LLMs: Ein (un)perfekter menschlicher Ansatz zur sicheren Kodierung?

Auch wenn es unvermeidlich scheint, dass die KI-Technologie im Stil des LLM die Art und Weise, wie wir an viele Aspekte der Arbeit herangehen - nicht nur an die Softwareentwicklung - verändern wird, müssen wir einen Schritt zurücktreten und die Risiken jenseits der Schlagzeilen betrachten. Und als KI-Begleiter sind ihre Schwächen vielleicht ihr "menschlichstes" Attribut.

Ressourcen für den Einstieg

Wie Envestnet einen agilen sicheren Code learning platform einführte und die Effektivität der Entwickler bei der Reduzierung von Schwachstellen verdreifachte

Erfahren Sie, wie Derek Fisher, Head of Product Security bei Envestnet und Autor von "The Application Security Handbook", in Zusammenarbeit mit Secure Code Warrior einen ganzheitlichen Ansatz entwickelt hat, um Schwachstellen durch agiles Secure Code Enablement für seine Entwicklerteams zu reduzieren.

Die Kamer van Koophandel setzt Maßstäbe für entwicklergesteuerte Sicherheit in großem Maßstab

Die Kamer van Koophandel berichtet, wie sie sicheres Codieren durch rollenbasierte Zertifizierungen, Trust Score-Benchmarking und eine Kultur der gemeinsamen Verantwortung für Sicherheit in die tägliche Entwicklungsarbeit integriert hat.

DigitalOcean verringert Sicherheitsverschuldung mit Secure Code Warrior

DigitalOceans Einsatz von Secure Code Warrior hat die Sicherheitsverschuldung deutlich reduziert, so dass sich die Teams stärker auf Innovation und Produktivität konzentrieren können. Die verbesserte Sicherheit hat die Produktqualität und den Wettbewerbsvorteil des Unternehmens gestärkt. Mit Blick auf die Zukunft wird der SCW Trust Score dem Unternehmen helfen, seine Sicherheitspraktiken weiter zu verbessern und Innovationen voranzutreiben.