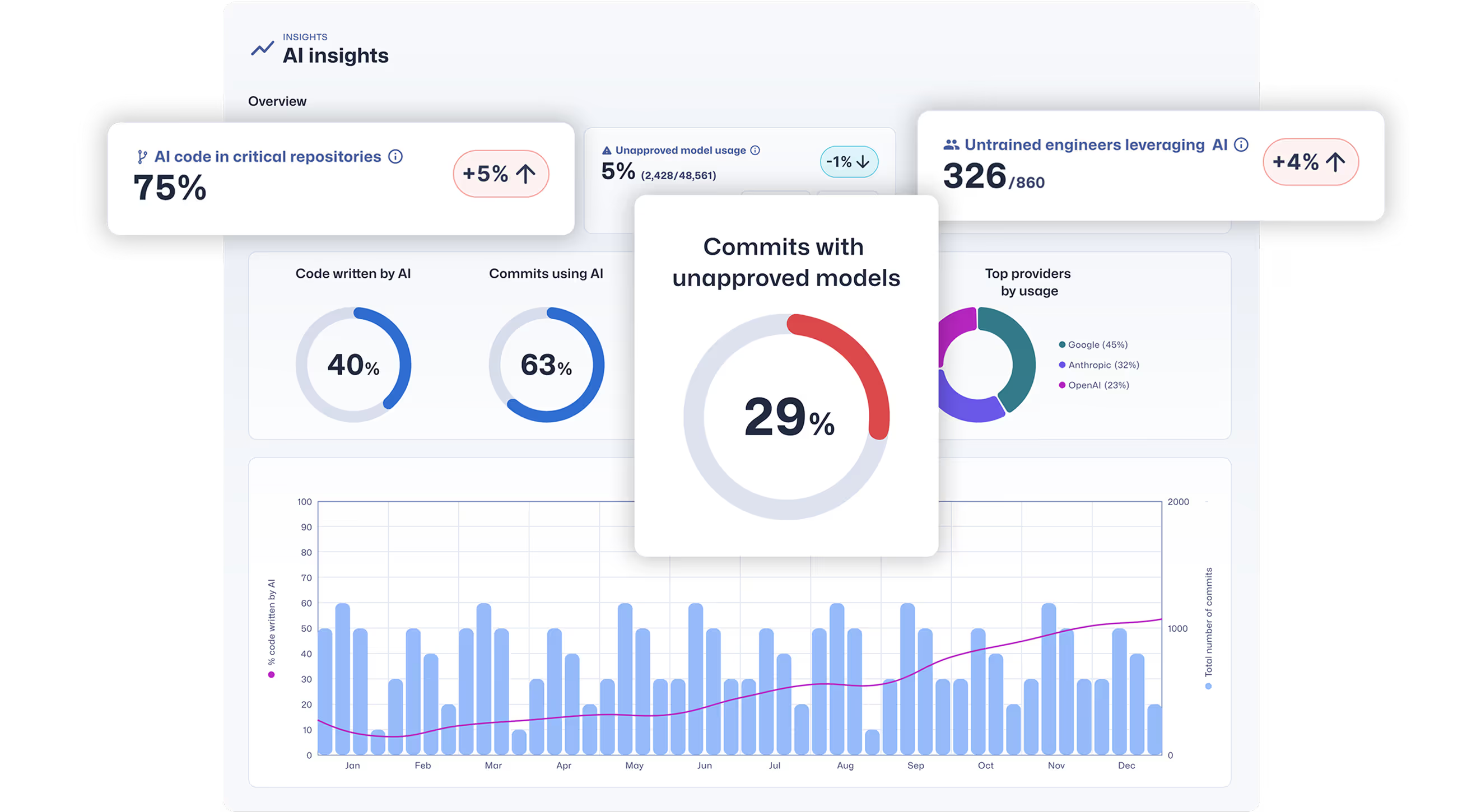

Trust Agent: KI erfasst nicht den Quellcode oder die Eingabeaufforderungen, sondern KI-Nutzungssignale und Commit-Metadaten, um die Privatsphäre der Entwickler zu schützen und gleichzeitig eine umfassende Governance zu unterstützen. Dadurch kann die KI-gestützte Entwicklung in einem sicheren SDLC geprüft und verwaltet werden, sodass Entwicklerrisiken vor der Produktion kontrolliert werden können.

Es macht die KI-gestützte Entwicklung über den gesamten sicheren SDLC hinweg sichtbar, überprüfbar und verwaltbar und hilft Unternehmen dabei, Risiken für Entwickler zu identifizieren und zu reduzieren, bevor der Code in die Produktion gelangt.