KI hat die Software-Lieferkette erweitert.

Der KI-Codierungsassistent, LLM und MCP-Verbindungsagent generieren nun Produktionscode im gesamten Repository. Die Entwicklungsgeschwindigkeit hat sich erhöht, aber die Governance konnte mit dieser Geschwindigkeit nicht Schritt halten. KI ist zu einem unkontrollierten Faktor in der Software-Lieferkette geworden.

Die meisten Organisationen können folgende Fragen nicht eindeutig beantworten.

- Welches KI-Modell hat einen bestimmten Commit erstellt?

- Ob dieses Modell kontinuierlich sichere Ergebnisse liefert

- Aktiver MCP-Server und Zugriffsziel

- AI-gestützte Commits erfüllen die Sicherheitscodierungsstandards

- Auswirkungen der KI-Nutzung auf das gesamte Software-Risiko

Ohne strukturierte KI-Software-Governance sind Unternehmen mit geteilten Eigentumsverhältnissen, eingeschränkter Transparenz und erhöhten Risiken konfrontiert. KI-gestützte Entwicklung beschleunigt zwar die Codierung , erhöht jedoch ohne strenge Aufsicht auch die Schwachstellenrisiken und die Gefährdung der Modell-Lieferkette.

Durchführbare Aufsicht über die KI-basierte Entwicklung

Dadurch kann die Organisation Folgendes tun:

- Sichtbarkeit darüber gewinnen, wo und wie KI eingesetzt wird

- Ermittlung der Korrelation zwischen KI-gestützten Commits und Software-Risiken

- Definition und Anwendung der KI-Nutzungsrichtlinien bei der Übermittlung

- Verstärkung der Verantwortung für die gesamte Entwicklung im Bereich Mensch und KI-Unterstützung

KI-Software-Lebenszyklusmanagement

Bestehende Anwendungssicherheitstools erkennen Schwachstellen nach der Codierung. KI-Software-Governance setzt Richtlinien durch, überprüft die Verwendung von KI-Modellen und analysiert die Korrelation von Risiken bei der Überführung, um zu verhindern, dass eingeführte Schwachstellen in die Produktion gelangen.

KI-Tools und Modell-Rückverfolgbarkeit

Erstellen Sie ein überprüfbares Inventar der verwendeten KI, indem Sie sich einen Überblick darüber verschaffen, welche KI-Tools und -Modelle im gesamten Repository Auswirkungen auf den Code haben.

Shadow AI Detection

Identifiziert nicht genehmigte KI-Tools und -Modelle, die außerhalb der genehmigten Governance-Kontrollen operieren.

LLM-Sicherheitsbenchmarking

Die Leistung von KI-Modellen wird anhand tatsächlicher Schwachstellenmuster bewertet, und zugelassene Modelle werden verbindlich vorgeschrieben.

Risikobewertung und Governance auf Commit-Ebene

Verbinden Sie KI-gestützte Commits mit Warnsignalen und wenden Sie umsetzbare Richtlinien an, bevor der Code in die Produktion gelangt.

MCP-Server-Sichtbarkeit

Identifizieren Sie den verwendeten MCP-Server und wenden Sie die Commit-Level-Richtlinie auf nicht autorisierte Verbindungen an.

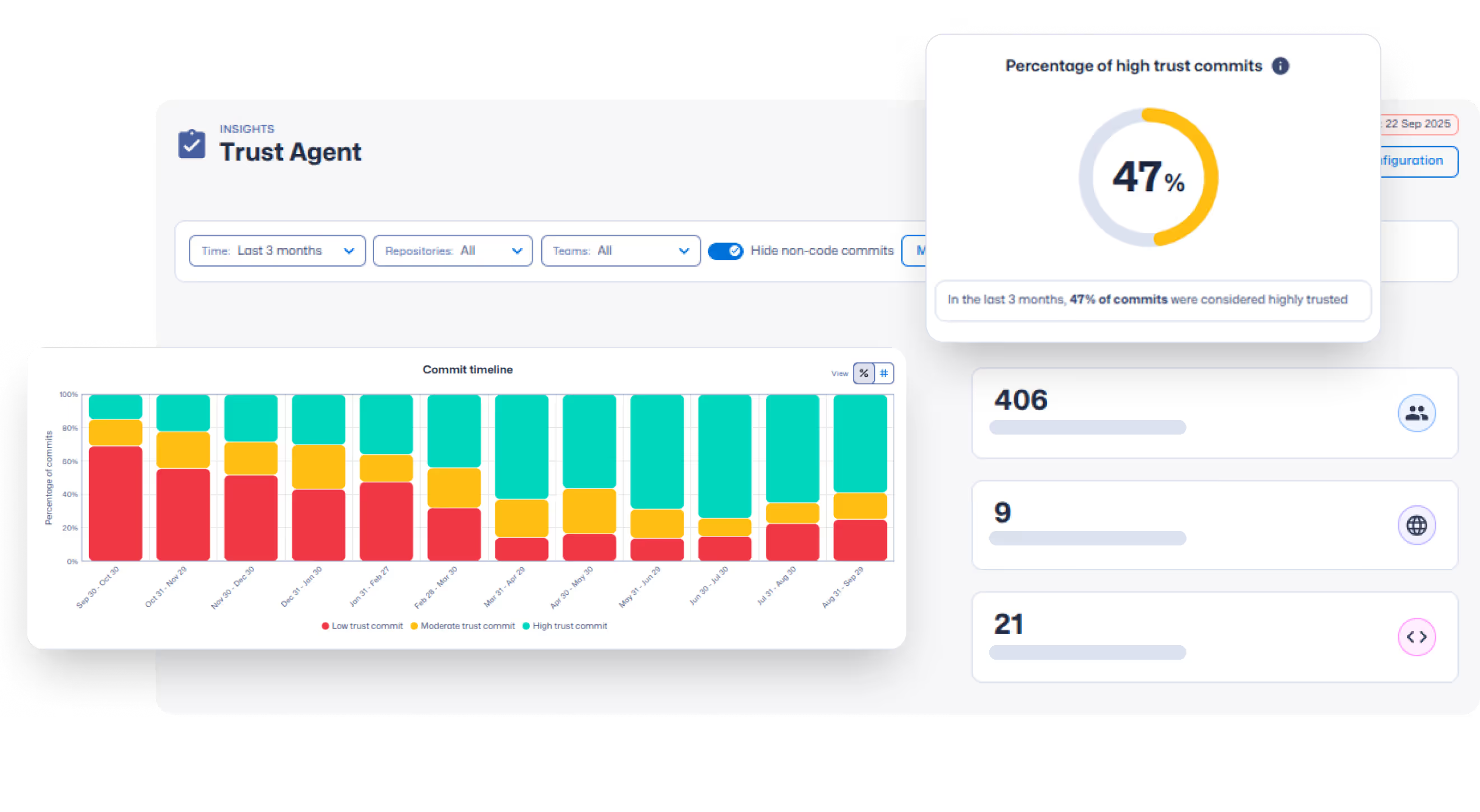

Entwickler-Discovery und Intelligenz

Entwickler, KI-Unterstützungsaktivitäten und Commit-Muster werden kontinuierlich identifiziert, um die Verantwortlichkeiten und Risiken besser sichtbar zu machen.

Wir verwalten die Entwicklung der KI-Unterstützung in vier Schritten.

Verbindung und Beobachtung

Durch die Integration mit Repositorys und CI-Systemen werden Commit-Metadaten, die Verwendung von KI-Modellen und die Aktivitäten der Mitwirkenden überwacht.

Das Publikum, das wir bedienen

Wir kennen diese Methode sehr gut. Wir bemühen uns, diese beiden Segnungen gleichermaßen zu leben.

Verwalten Sie die KI-basierte Entwicklung vor der Markteinführung.

Verfolgen Sie die Verwendung von KI-Modellen. Wenden Sie bei der Bereitstellung Richtlinien an. Behalten Sie die Kontrolle über die KI-Software-Lieferkette, um für Audits gerüstet zu sein.

Steuerung, Messung und Sicherheit bei der Entwicklung von KI-gestützter Software

Erfahren Sie, wie Secure Code Warrior KI-Transparenz, Richtlinienumsetzung und Governance im gesamten KI-gestützten Entwicklungs-Workflow ermöglicht.