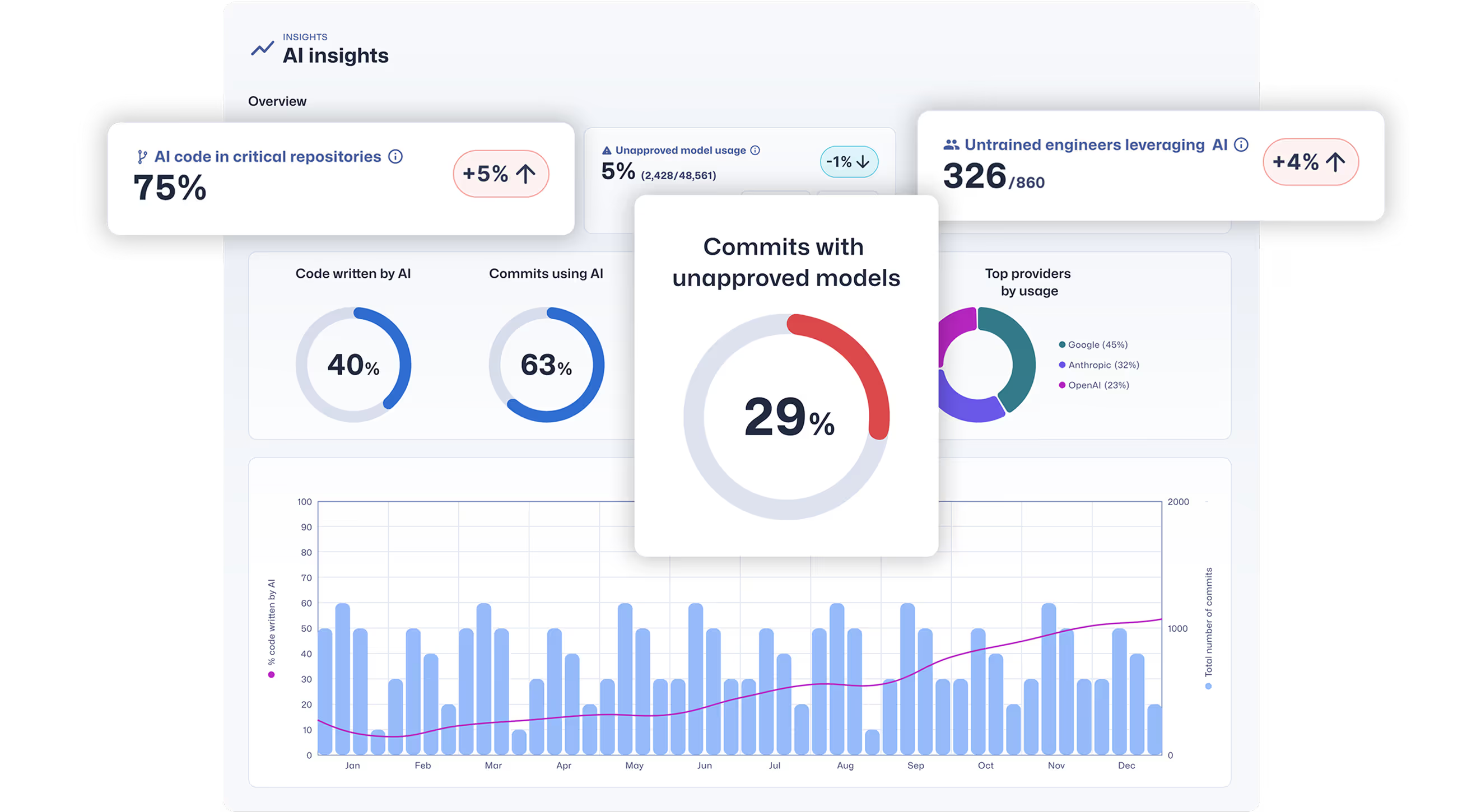

Agent de confiance : l'IA capture les signaux d'utilisation de l'IA et valide les métadonnées, et non le code source ou les instructions, tout en préservant la confidentialité des développeurs tout en permettant une gouvernance à grande échelle. Il rend le développement assisté par l'IA auditable et géré à travers le SDLC sécurisé, gérant ainsi les risques pour les développeurs avant la production.

Es macht die KI-gestützte Entwicklung über den gesamten sicheren SDLC hinweg sichtbar, überprüfbar und verwaltbar und hilft Unternehmen dabei, Risiken für Entwickler zu identifizieren und zu reduzieren, bevor der Code in die Produktion gelangt.