SCW Trust Agent: AI - Sichtbarkeit und Governance für Ihren AI-gestützten SDLC

Die breite Einführung von KI-Codierungstools verändert die Softwareentwicklung. 78 % der Entwickler1 nutzen inzwischen KI, um ihre Produktivität zu steigern, und die Innovationsgeschwindigkeit war noch nie so hoch. Doch diese rasante Beschleunigung birgt auch ein kritisches Risiko.

Studien zeigen, dass bis zu 50 % des funktionell korrekten, von KI erzeugten Codes unsicher ist2. Dies ist kein kleiner Fehler, sondern eine systemische Herausforderung. Das bedeutet, dass jedes Mal, wenn ein Entwickler ein Tool wie GitHub Copilot oder ChatGPT verwendet, er unwissentlich neue Schwachstellen in Ihre Codebasis einbringen könnte. Das Ergebnis ist eine gefährliche Mischung aus Geschwindigkeit und Sicherheitsrisiken, für die die meisten Unternehmen nicht gerüstet sind.

Die Herausforderung der "Schatten-KI"

Ohne eine Möglichkeit, die Verwendung von KI-Codierungstools zu verwalten, sind CISO, AppSec und technische Leiter neuen Risiken ausgesetzt, die sie nicht sehen oder messen können. Wie können Sie entscheidende Fragen beantworten wie:

- Wie viel Prozent unseres Codes ist KI-generiert?

- Welche MCPs werden verwendet?

- Welche nicht zugelassenen Modelle werden verwendet?

- Welche Schwachstellen werden durch die verschiedenen Modelle verursacht?

Der Mangel an Transparenz und Kontrolle schafft eine neue Ebene von Risiken und Unsicherheit. Es ist die eigentliche Definition von "Schatten-IT", aber für Ihre Codebasis.

Unsere Lösung - Trust Agent: AI

Wir glauben, dass Sie beides haben können: Geschwindigkeit und Sicherheit. Wir sind stolz auf die Einführung von Vertrauens-Agent: AIvorzustellen, eine leistungsstarke neue Funktion unseres Trust Agent-Produkts, die Ihnen die tiefgreifende Beobachtbarkeit und Kontrolle bietet, die Sie benötigen, um KI in Ihrem Softwareentwicklungslebenszyklus sicher einzusetzen. Mit einer einzigartigen Kombination von Signalen bietet Trust Agent: AI zur Verfügung:

- Transparenz: Sehen Sie, welche Entwickler welche KI-Codierungstools, LLMs und MCPs verwenden und auf welchen Codebasen. Keine „Schatten-KI“ mehr.

- Risiko-Metriken: Verknüpfen Sie KI-generierten Code mit dem Qualifikationsniveau eines Entwicklers und eingeführten Schwachstellen, um das tatsächliche Risiko auf Commit-Ebene zu verstehen.

- Steuerung: Automatisieren Sie die Durchsetzung von Richtlinien, um sicherzustellen, dass KI-fähige Entwickler sichere Kodierungsstandards einhalten.

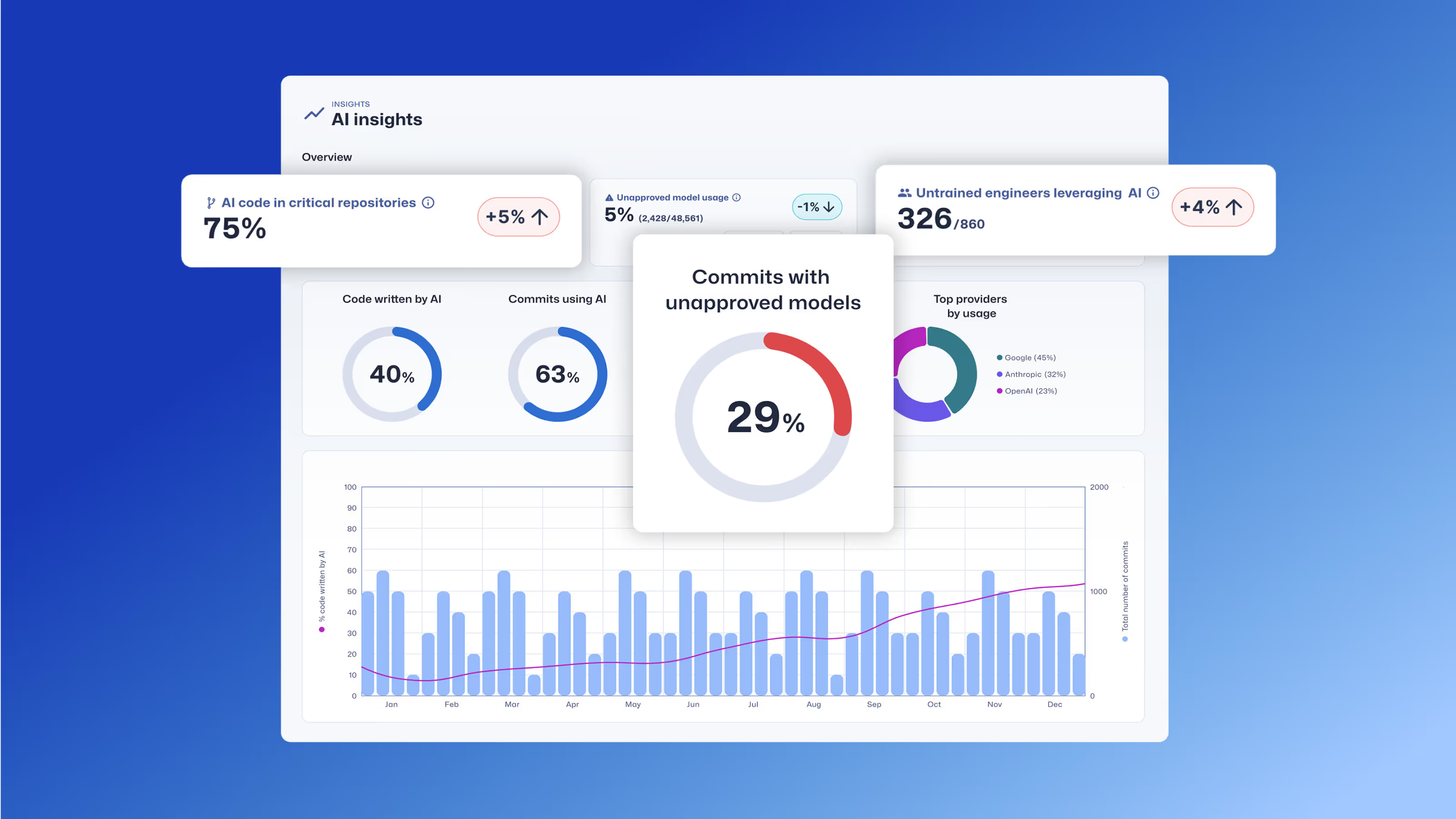

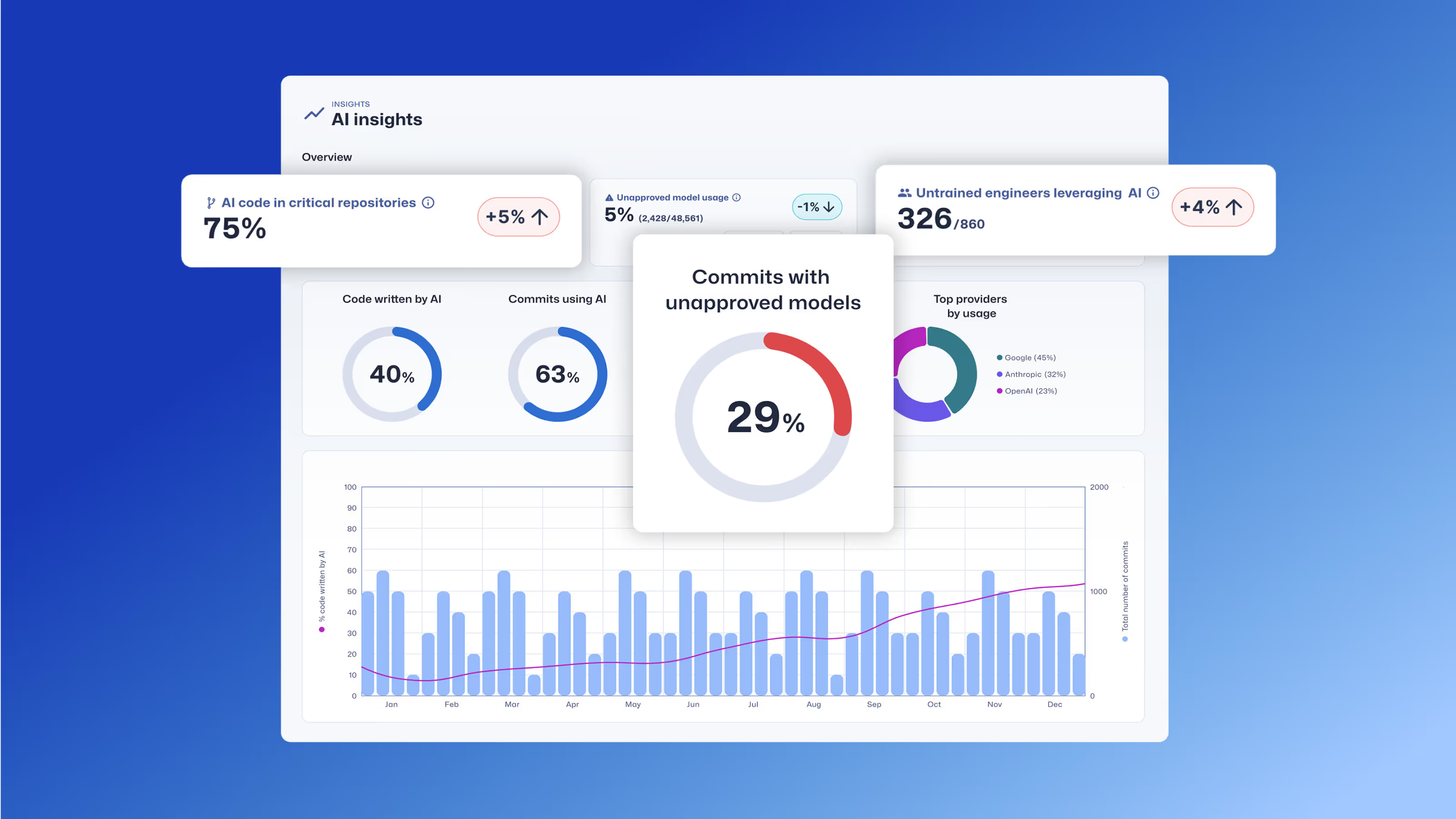

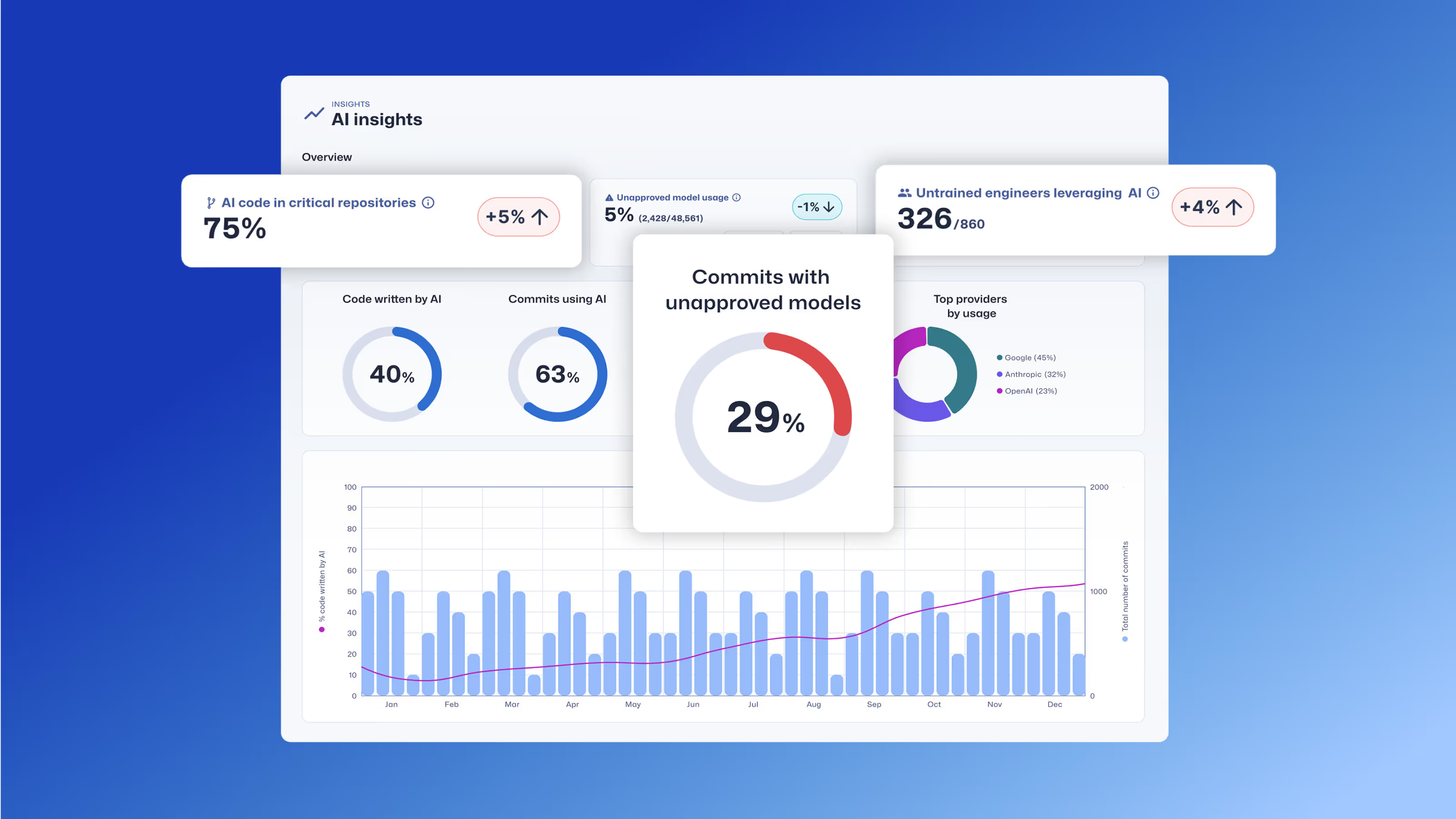

Der Trust Agent: AI-Dashboard bietet Einblicke in die Nutzung von KI-Codierwerkzeugen, beitragende Entwickler, Code-Repository und mehr.

Die Rolle des Entwicklers: Die letzte Verteidigungslinie

Während Trust Agent: AI bietet Ihnen eine beispiellose Governance, aber wir wissen, dass der Entwickler die letzte und wichtigste Verteidigungslinie bleibt. Der effektivste Weg, das Risiko von KI-generiertem Code zu verwalten, besteht darin, sicherzustellen, dass Ihre Entwickler über die Sicherheitsfähigkeiten verfügen, um diesen Code zu überprüfen, zu validieren und zu sichern. Hier kommt SCW Learning, Teil unserer umfassenden Plattform für das Risikomanagement von Entwicklern, ins Spiel. Mit SCW Learning statten wir Ihre Entwickler mit den praktischen Fähigkeiten aus, die sie benötigen, um KI sicher und produktiv zu nutzen. Das Produkt SCW Learning umfasst:

- SCW Trust Score: Ein branchenweit einzigartiger Benchmark, der die Sicherheitskompetenz von Entwicklern quantifiziert und es Ihnen ermöglicht, die Entwickler zu identifizieren, die am besten für den Umgang mit KI-generiertem Code gerüstet sind.

- KI-Herausforderungen: Interaktive, reale Programmierherausforderungen, bei denen Entwickler lernen, wie sie Schwachstellen in KI-generiertem Code finden und beheben können.

- Gezieltes Lernen: Kuratierte Lernpfade aus mehr als 200 KI-Herausforderungen, Leitfäden, Komplettlösungen, Missions, Quests und Courses , die die Prinzipien der sicheren Kodierung verstärken und Entwicklern dabei helfen, die zur Minderung von KI-Risiken erforderlichen Sicherheitsfähigkeiten zu beherrschen.

Durch die Kombination der leistungsstarken Governance von Trust Agent: AI mit der Kompetenzentwicklung unseres Lernprodukts können Sie einen wirklich sicheren SDLC schaffen. Sie werden in der Lage sein, Risiken zu identifizieren, Richtlinien durchzusetzen und Ihre Entwickler zu befähigen, Code schneller und sicherer als je zuvor zu erstellen.

Sind Sie bereit, Ihre AI-Reise zu sichern?

Das Zeitalter der KI ist angebrochen, und als Produktmanagerin ist es mein Ziel, Lösungen zu entwickeln, die nicht nur die Probleme von heute lösen, sondern auch die von morgen vorwegnehmen. Trust Agent: AI wurde entwickelt, um genau das zu tun und Ihnen die Sichtbarkeit und Kontrolle zu geben, um KI-Risiken zu managen und gleichzeitig Ihre Teams zu befähigen, innovativ zu sein. Die Early-Access-Beta ist jetzt live, und wir würden uns freuen, wenn Sie daran teilnehmen würden. Es geht nicht nur um ein neues Produkt, sondern darum, einen neuen Standard für die sichere Softwareentwicklung in einer KI-zentrierten Welt zu setzen.

Kommen Sie noch heute auf die Warteliste für den frühen Zugang!

Erfahren Sie, wie Trust Agent: AI bietet umfassende Transparenz und Governance für KI-generierten Code und ermöglicht es Unternehmen, schneller und sicherer zu innovieren.

Secure Code Warrior schützt Ihren Code während des gesamten Softwareentwicklungszyklus und hilft Ihnen dabei, eine Kultur zu schaffen, in der Cybersicherheit oberste Priorität hat. Ganz gleich, ob Sie Anwendungs-Sicherheitsmanager, Entwickler, CISO oder Sicherheitsbeauftragter sind – wir helfen Ihnen dabei, die mit unsicherem Code verbundenen Risiken zu minimieren.

デモを予約Secure Code Warriorの製品管理担当ディレクターであるTamim Noorzadは、エンジニアからプロダクトマネージャーに転向し、17年以上の経験を持ち、SaaS 0対1製品を専門としています。

Die breite Einführung von KI-Codierungstools verändert die Softwareentwicklung. 78 % der Entwickler1 nutzen inzwischen KI, um ihre Produktivität zu steigern, und die Innovationsgeschwindigkeit war noch nie so hoch. Doch diese rasante Beschleunigung birgt auch ein kritisches Risiko.

Studien zeigen, dass bis zu 50 % des funktionell korrekten, von KI erzeugten Codes unsicher ist2. Dies ist kein kleiner Fehler, sondern eine systemische Herausforderung. Das bedeutet, dass jedes Mal, wenn ein Entwickler ein Tool wie GitHub Copilot oder ChatGPT verwendet, er unwissentlich neue Schwachstellen in Ihre Codebasis einbringen könnte. Das Ergebnis ist eine gefährliche Mischung aus Geschwindigkeit und Sicherheitsrisiken, für die die meisten Unternehmen nicht gerüstet sind.

Die Herausforderung der "Schatten-KI"

Ohne eine Möglichkeit, die Verwendung von KI-Codierungstools zu verwalten, sind CISO, AppSec und technische Leiter neuen Risiken ausgesetzt, die sie nicht sehen oder messen können. Wie können Sie entscheidende Fragen beantworten wie:

- Wie viel Prozent unseres Codes ist KI-generiert?

- Welche MCPs werden verwendet?

- Welche nicht zugelassenen Modelle werden verwendet?

- Welche Schwachstellen werden durch die verschiedenen Modelle verursacht?

Der Mangel an Transparenz und Kontrolle schafft eine neue Ebene von Risiken und Unsicherheit. Es ist die eigentliche Definition von "Schatten-IT", aber für Ihre Codebasis.

Unsere Lösung - Trust Agent: AI

Wir glauben, dass Sie beides haben können: Geschwindigkeit und Sicherheit. Wir sind stolz auf die Einführung von Vertrauens-Agent: AIvorzustellen, eine leistungsstarke neue Funktion unseres Trust Agent-Produkts, die Ihnen die tiefgreifende Beobachtbarkeit und Kontrolle bietet, die Sie benötigen, um KI in Ihrem Softwareentwicklungslebenszyklus sicher einzusetzen. Mit einer einzigartigen Kombination von Signalen bietet Trust Agent: AI zur Verfügung:

- Transparenz: Sehen Sie, welche Entwickler welche KI-Codierungstools, LLMs und MCPs verwenden und auf welchen Codebasen. Keine „Schatten-KI“ mehr.

- Risiko-Metriken: Verknüpfen Sie KI-generierten Code mit dem Qualifikationsniveau eines Entwicklers und eingeführten Schwachstellen, um das tatsächliche Risiko auf Commit-Ebene zu verstehen.

- Steuerung: Automatisieren Sie die Durchsetzung von Richtlinien, um sicherzustellen, dass KI-fähige Entwickler sichere Kodierungsstandards einhalten.

Der Trust Agent: AI-Dashboard bietet Einblicke in die Nutzung von KI-Codierwerkzeugen, beitragende Entwickler, Code-Repository und mehr.

Die Rolle des Entwicklers: Die letzte Verteidigungslinie

Während Trust Agent: AI bietet Ihnen eine beispiellose Governance, aber wir wissen, dass der Entwickler die letzte und wichtigste Verteidigungslinie bleibt. Der effektivste Weg, das Risiko von KI-generiertem Code zu verwalten, besteht darin, sicherzustellen, dass Ihre Entwickler über die Sicherheitsfähigkeiten verfügen, um diesen Code zu überprüfen, zu validieren und zu sichern. Hier kommt SCW Learning, Teil unserer umfassenden Plattform für das Risikomanagement von Entwicklern, ins Spiel. Mit SCW Learning statten wir Ihre Entwickler mit den praktischen Fähigkeiten aus, die sie benötigen, um KI sicher und produktiv zu nutzen. Das Produkt SCW Learning umfasst:

- SCW Trust Score: Ein branchenweit einzigartiger Benchmark, der die Sicherheitskompetenz von Entwicklern quantifiziert und es Ihnen ermöglicht, die Entwickler zu identifizieren, die am besten für den Umgang mit KI-generiertem Code gerüstet sind.

- KI-Herausforderungen: Interaktive, reale Programmierherausforderungen, bei denen Entwickler lernen, wie sie Schwachstellen in KI-generiertem Code finden und beheben können.

- Gezieltes Lernen: Kuratierte Lernpfade aus mehr als 200 KI-Herausforderungen, Leitfäden, Komplettlösungen, Missions, Quests und Courses , die die Prinzipien der sicheren Kodierung verstärken und Entwicklern dabei helfen, die zur Minderung von KI-Risiken erforderlichen Sicherheitsfähigkeiten zu beherrschen.

Durch die Kombination der leistungsstarken Governance von Trust Agent: AI mit der Kompetenzentwicklung unseres Lernprodukts können Sie einen wirklich sicheren SDLC schaffen. Sie werden in der Lage sein, Risiken zu identifizieren, Richtlinien durchzusetzen und Ihre Entwickler zu befähigen, Code schneller und sicherer als je zuvor zu erstellen.

Sind Sie bereit, Ihre AI-Reise zu sichern?

Das Zeitalter der KI ist angebrochen, und als Produktmanagerin ist es mein Ziel, Lösungen zu entwickeln, die nicht nur die Probleme von heute lösen, sondern auch die von morgen vorwegnehmen. Trust Agent: AI wurde entwickelt, um genau das zu tun und Ihnen die Sichtbarkeit und Kontrolle zu geben, um KI-Risiken zu managen und gleichzeitig Ihre Teams zu befähigen, innovativ zu sein. Die Early-Access-Beta ist jetzt live, und wir würden uns freuen, wenn Sie daran teilnehmen würden. Es geht nicht nur um ein neues Produkt, sondern darum, einen neuen Standard für die sichere Softwareentwicklung in einer KI-zentrierten Welt zu setzen.

Kommen Sie noch heute auf die Warteliste für den frühen Zugang!

Die breite Einführung von KI-Codierungstools verändert die Softwareentwicklung. 78 % der Entwickler1 nutzen inzwischen KI, um ihre Produktivität zu steigern, und die Innovationsgeschwindigkeit war noch nie so hoch. Doch diese rasante Beschleunigung birgt auch ein kritisches Risiko.

Studien zeigen, dass bis zu 50 % des funktionell korrekten, von KI erzeugten Codes unsicher ist2. Dies ist kein kleiner Fehler, sondern eine systemische Herausforderung. Das bedeutet, dass jedes Mal, wenn ein Entwickler ein Tool wie GitHub Copilot oder ChatGPT verwendet, er unwissentlich neue Schwachstellen in Ihre Codebasis einbringen könnte. Das Ergebnis ist eine gefährliche Mischung aus Geschwindigkeit und Sicherheitsrisiken, für die die meisten Unternehmen nicht gerüstet sind.

Die Herausforderung der "Schatten-KI"

Ohne eine Möglichkeit, die Verwendung von KI-Codierungstools zu verwalten, sind CISO, AppSec und technische Leiter neuen Risiken ausgesetzt, die sie nicht sehen oder messen können. Wie können Sie entscheidende Fragen beantworten wie:

- Wie viel Prozent unseres Codes ist KI-generiert?

- Welche MCPs werden verwendet?

- Welche nicht zugelassenen Modelle werden verwendet?

- Welche Schwachstellen werden durch die verschiedenen Modelle verursacht?

Der Mangel an Transparenz und Kontrolle schafft eine neue Ebene von Risiken und Unsicherheit. Es ist die eigentliche Definition von "Schatten-IT", aber für Ihre Codebasis.

Unsere Lösung - Trust Agent: AI

Wir glauben, dass Sie beides haben können: Geschwindigkeit und Sicherheit. Wir sind stolz auf die Einführung von Vertrauens-Agent: AIvorzustellen, eine leistungsstarke neue Funktion unseres Trust Agent-Produkts, die Ihnen die tiefgreifende Beobachtbarkeit und Kontrolle bietet, die Sie benötigen, um KI in Ihrem Softwareentwicklungslebenszyklus sicher einzusetzen. Mit einer einzigartigen Kombination von Signalen bietet Trust Agent: AI zur Verfügung:

- Transparenz: Sehen Sie, welche Entwickler welche KI-Codierungstools, LLMs und MCPs verwenden und auf welchen Codebasen. Keine „Schatten-KI“ mehr.

- Risiko-Metriken: Verknüpfen Sie KI-generierten Code mit dem Qualifikationsniveau eines Entwicklers und eingeführten Schwachstellen, um das tatsächliche Risiko auf Commit-Ebene zu verstehen.

- Steuerung: Automatisieren Sie die Durchsetzung von Richtlinien, um sicherzustellen, dass KI-fähige Entwickler sichere Kodierungsstandards einhalten.

Der Trust Agent: AI-Dashboard bietet Einblicke in die Nutzung von KI-Codierwerkzeugen, beitragende Entwickler, Code-Repository und mehr.

Die Rolle des Entwicklers: Die letzte Verteidigungslinie

Während Trust Agent: AI bietet Ihnen eine beispiellose Governance, aber wir wissen, dass der Entwickler die letzte und wichtigste Verteidigungslinie bleibt. Der effektivste Weg, das Risiko von KI-generiertem Code zu verwalten, besteht darin, sicherzustellen, dass Ihre Entwickler über die Sicherheitsfähigkeiten verfügen, um diesen Code zu überprüfen, zu validieren und zu sichern. Hier kommt SCW Learning, Teil unserer umfassenden Plattform für das Risikomanagement von Entwicklern, ins Spiel. Mit SCW Learning statten wir Ihre Entwickler mit den praktischen Fähigkeiten aus, die sie benötigen, um KI sicher und produktiv zu nutzen. Das Produkt SCW Learning umfasst:

- SCW Trust Score: Ein branchenweit einzigartiger Benchmark, der die Sicherheitskompetenz von Entwicklern quantifiziert und es Ihnen ermöglicht, die Entwickler zu identifizieren, die am besten für den Umgang mit KI-generiertem Code gerüstet sind.

- KI-Herausforderungen: Interaktive, reale Programmierherausforderungen, bei denen Entwickler lernen, wie sie Schwachstellen in KI-generiertem Code finden und beheben können.

- Gezieltes Lernen: Kuratierte Lernpfade aus mehr als 200 KI-Herausforderungen, Leitfäden, Komplettlösungen, Missions, Quests und Courses , die die Prinzipien der sicheren Kodierung verstärken und Entwicklern dabei helfen, die zur Minderung von KI-Risiken erforderlichen Sicherheitsfähigkeiten zu beherrschen.

Durch die Kombination der leistungsstarken Governance von Trust Agent: AI mit der Kompetenzentwicklung unseres Lernprodukts können Sie einen wirklich sicheren SDLC schaffen. Sie werden in der Lage sein, Risiken zu identifizieren, Richtlinien durchzusetzen und Ihre Entwickler zu befähigen, Code schneller und sicherer als je zuvor zu erstellen.

Sind Sie bereit, Ihre AI-Reise zu sichern?

Das Zeitalter der KI ist angebrochen, und als Produktmanagerin ist es mein Ziel, Lösungen zu entwickeln, die nicht nur die Probleme von heute lösen, sondern auch die von morgen vorwegnehmen. Trust Agent: AI wurde entwickelt, um genau das zu tun und Ihnen die Sichtbarkeit und Kontrolle zu geben, um KI-Risiken zu managen und gleichzeitig Ihre Teams zu befähigen, innovativ zu sein. Die Early-Access-Beta ist jetzt live, und wir würden uns freuen, wenn Sie daran teilnehmen würden. Es geht nicht nur um ein neues Produkt, sondern darum, einen neuen Standard für die sichere Softwareentwicklung in einer KI-zentrierten Welt zu setzen.

Kommen Sie noch heute auf die Warteliste für den frühen Zugang!

Klicken Sie auf den folgenden Link, um die PDF-Datei dieser Ressource herunterzuladen.

Secure Code Warrior schützt Ihren Code während des gesamten Softwareentwicklungszyklus und hilft Ihnen dabei, eine Kultur zu schaffen, in der Cybersicherheit oberste Priorität hat. Ganz gleich, ob Sie Anwendungs-Sicherheitsmanager, Entwickler, CISO oder Sicherheitsbeauftragter sind – wir helfen Ihnen dabei, die mit unsicherem Code verbundenen Risiken zu minimieren.

Bericht anzeigenデモを予約Secure Code Warriorの製品管理担当ディレクターであるTamim Noorzadは、エンジニアからプロダクトマネージャーに転向し、17年以上の経験を持ち、SaaS 0対1製品を専門としています。

Die breite Einführung von KI-Codierungstools verändert die Softwareentwicklung. 78 % der Entwickler1 nutzen inzwischen KI, um ihre Produktivität zu steigern, und die Innovationsgeschwindigkeit war noch nie so hoch. Doch diese rasante Beschleunigung birgt auch ein kritisches Risiko.

Studien zeigen, dass bis zu 50 % des funktionell korrekten, von KI erzeugten Codes unsicher ist2. Dies ist kein kleiner Fehler, sondern eine systemische Herausforderung. Das bedeutet, dass jedes Mal, wenn ein Entwickler ein Tool wie GitHub Copilot oder ChatGPT verwendet, er unwissentlich neue Schwachstellen in Ihre Codebasis einbringen könnte. Das Ergebnis ist eine gefährliche Mischung aus Geschwindigkeit und Sicherheitsrisiken, für die die meisten Unternehmen nicht gerüstet sind.

Die Herausforderung der "Schatten-KI"

Ohne eine Möglichkeit, die Verwendung von KI-Codierungstools zu verwalten, sind CISO, AppSec und technische Leiter neuen Risiken ausgesetzt, die sie nicht sehen oder messen können. Wie können Sie entscheidende Fragen beantworten wie:

- Wie viel Prozent unseres Codes ist KI-generiert?

- Welche MCPs werden verwendet?

- Welche nicht zugelassenen Modelle werden verwendet?

- Welche Schwachstellen werden durch die verschiedenen Modelle verursacht?

Der Mangel an Transparenz und Kontrolle schafft eine neue Ebene von Risiken und Unsicherheit. Es ist die eigentliche Definition von "Schatten-IT", aber für Ihre Codebasis.

Unsere Lösung - Trust Agent: AI

Wir glauben, dass Sie beides haben können: Geschwindigkeit und Sicherheit. Wir sind stolz auf die Einführung von Vertrauens-Agent: AIvorzustellen, eine leistungsstarke neue Funktion unseres Trust Agent-Produkts, die Ihnen die tiefgreifende Beobachtbarkeit und Kontrolle bietet, die Sie benötigen, um KI in Ihrem Softwareentwicklungslebenszyklus sicher einzusetzen. Mit einer einzigartigen Kombination von Signalen bietet Trust Agent: AI zur Verfügung:

- Transparenz: Sehen Sie, welche Entwickler welche KI-Codierungstools, LLMs und MCPs verwenden und auf welchen Codebasen. Keine „Schatten-KI“ mehr.

- Risiko-Metriken: Verknüpfen Sie KI-generierten Code mit dem Qualifikationsniveau eines Entwicklers und eingeführten Schwachstellen, um das tatsächliche Risiko auf Commit-Ebene zu verstehen.

- Steuerung: Automatisieren Sie die Durchsetzung von Richtlinien, um sicherzustellen, dass KI-fähige Entwickler sichere Kodierungsstandards einhalten.

Der Trust Agent: AI-Dashboard bietet Einblicke in die Nutzung von KI-Codierwerkzeugen, beitragende Entwickler, Code-Repository und mehr.

Die Rolle des Entwicklers: Die letzte Verteidigungslinie

Während Trust Agent: AI bietet Ihnen eine beispiellose Governance, aber wir wissen, dass der Entwickler die letzte und wichtigste Verteidigungslinie bleibt. Der effektivste Weg, das Risiko von KI-generiertem Code zu verwalten, besteht darin, sicherzustellen, dass Ihre Entwickler über die Sicherheitsfähigkeiten verfügen, um diesen Code zu überprüfen, zu validieren und zu sichern. Hier kommt SCW Learning, Teil unserer umfassenden Plattform für das Risikomanagement von Entwicklern, ins Spiel. Mit SCW Learning statten wir Ihre Entwickler mit den praktischen Fähigkeiten aus, die sie benötigen, um KI sicher und produktiv zu nutzen. Das Produkt SCW Learning umfasst:

- SCW Trust Score: Ein branchenweit einzigartiger Benchmark, der die Sicherheitskompetenz von Entwicklern quantifiziert und es Ihnen ermöglicht, die Entwickler zu identifizieren, die am besten für den Umgang mit KI-generiertem Code gerüstet sind.

- KI-Herausforderungen: Interaktive, reale Programmierherausforderungen, bei denen Entwickler lernen, wie sie Schwachstellen in KI-generiertem Code finden und beheben können.

- Gezieltes Lernen: Kuratierte Lernpfade aus mehr als 200 KI-Herausforderungen, Leitfäden, Komplettlösungen, Missions, Quests und Courses , die die Prinzipien der sicheren Kodierung verstärken und Entwicklern dabei helfen, die zur Minderung von KI-Risiken erforderlichen Sicherheitsfähigkeiten zu beherrschen.

Durch die Kombination der leistungsstarken Governance von Trust Agent: AI mit der Kompetenzentwicklung unseres Lernprodukts können Sie einen wirklich sicheren SDLC schaffen. Sie werden in der Lage sein, Risiken zu identifizieren, Richtlinien durchzusetzen und Ihre Entwickler zu befähigen, Code schneller und sicherer als je zuvor zu erstellen.

Sind Sie bereit, Ihre AI-Reise zu sichern?

Das Zeitalter der KI ist angebrochen, und als Produktmanagerin ist es mein Ziel, Lösungen zu entwickeln, die nicht nur die Probleme von heute lösen, sondern auch die von morgen vorwegnehmen. Trust Agent: AI wurde entwickelt, um genau das zu tun und Ihnen die Sichtbarkeit und Kontrolle zu geben, um KI-Risiken zu managen und gleichzeitig Ihre Teams zu befähigen, innovativ zu sein. Die Early-Access-Beta ist jetzt live, und wir würden uns freuen, wenn Sie daran teilnehmen würden. Es geht nicht nur um ein neues Produkt, sondern darum, einen neuen Standard für die sichere Softwareentwicklung in einer KI-zentrierten Welt zu setzen.

Kommen Sie noch heute auf die Warteliste für den frühen Zugang!

目次

Secure Code Warrior schützt Ihren Code während des gesamten Softwareentwicklungszyklus und hilft Ihnen dabei, eine Kultur zu schaffen, in der Cybersicherheit oberste Priorität hat. Ganz gleich, ob Sie Anwendungs-Sicherheitsmanager, Entwickler, CISO oder Sicherheitsbeauftragter sind – wir helfen Ihnen dabei, die mit unsicherem Code verbundenen Risiken zu minimieren.

デモを予約[ダウンロード]Ressourcen für den Einstieg

Themen und Inhalte der Secure-Code-Schulung

Unsere branchenführenden Inhalte werden unter Berücksichtigung der Aufgaben unserer Kunden ständig weiterentwickelt, um mit der sich ständig verändernden Softwareentwicklungsumgebung Schritt zu halten. Sie decken alle Themen von KI bis hin zu XQuery-Injection ab und sind für verschiedene Aufgabenbereiche konzipiert, von Architekten und Ingenieuren bis hin zu Produktmanagern und Qualitätssicherungsfachleuten. Werfen Sie einen Blick auf die Inhalte unseres Content-Katalogs, sortiert nach Themen und Aufgabenbereichen.

Die Kamer van Koophandel setzt Maßstäbe für entwicklergesteuerte Sicherheit in großem Maßstab

Die Kamer van Koophandel berichtet, wie sie sicheres Codieren durch rollenbasierte Zertifizierungen, Trust Score-Benchmarking und eine Kultur der gemeinsamen Verantwortung für Sicherheit in die tägliche Entwicklungsarbeit integriert hat.

Bedrohungsmodellierung mit KI: So wird jeder Entwickler zum Bedrohungsmodellierer

Sie werden besser gerüstet sein, um Entwicklern dabei zu helfen, Ideen und Techniken zur Bedrohungsmodellierung mit den KI-Tools zu kombinieren, die sie bereits verwenden, um die Sicherheit zu erhöhen, die Zusammenarbeit zu verbessern und von Anfang an widerstandsfähigere Software zu entwickeln.

Ressourcen für den Einstieg

Cybermon ist zurück: Die KI-Mission zum Besiegen des Bosses ist jetzt auf Abruf verfügbar.

「Cybermon 2025 Beat the Boss」 kann nun das ganze Jahr über bei SCW gespielt werden. Führen Sie anspruchsvolle AI/LLM-Sicherheitsherausforderungen ein, um die sichere AI-Entwicklung in großem Maßstab zu stärken.

Erläuterung des Cyber-Resilience-Gesetzes: Bedeutung für die Entwicklung sicherer Software

Erfahren Sie, was das EU-Gesetz zur Cyberresilienz (CRA) verlangt, für wen es gilt und wie sich Ingenieurteams auf Secure-by-Design-Praktiken, Schwachstellenprävention und die Kompetenzentwicklung von Entwicklern vorbereiten können.

Enabler 1: Definierte und messbare Erfolgskriterien

Enabler 1 ist der erste Teil der zehnteiligen Reihe „Enablers of Success“ und zeigt, wie sichere Programmierung mit geschäftlichen Ergebnissen wie Risikominderung und Geschwindigkeit verknüpft werden kann, um Programme langfristig zu optimieren.

.avif)

%20(1).avif)

.avif)