AI kann Code schreiben, aber Fähigkeiten schützen ihn.

Unsere sichere Codierungsplattform für Unternehmen vermittelt die erforderlichen Fähigkeiten, um sowohl von Menschen als auch von KI generierten Code zu schützen, ohne die Bereitstellung zu verzögern.

KI beschleunigt die Codierung. Sichere Codierungskenntnisse müssen damit Schritt halten.

Der KI-Codierungsassistent kann Code generieren, der sofort in der Produktionsumgebung verwendet werden kann. Allerdings ist Geschwindigkeit nicht gleichbedeutend mit Sicherheit.

従来のセキュリティトレーニングは次のことに重点を置いています —機能ではありません。スタティックスキャンは問題が発生した後に問題を検出します。 ソフトウェアリスクを軽減するには、安全なコーディング動作を改善する必要がある 安全なコーディング機能は、効果的なAIソフトウェアガバナンスの基盤です。

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

Sichere Codierungsfähigkeiten in großem Umfang aufbauen

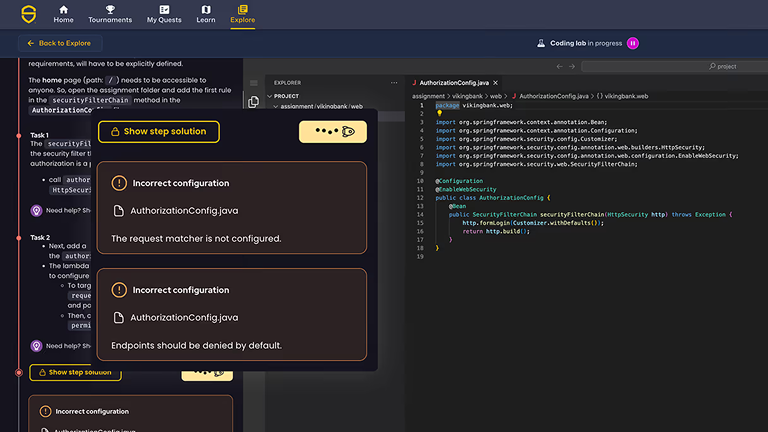

Hands-on Secure Coding Lab

Entwickler beheben reale Schwachstellen durch interaktive Übungen in über 75 Sprachen und Frameworks.

AI-spezifisches Sicherheitsmodul

Verifizierung und Schutz von KI-generiertem Code, Erkennung unsicherer Muster und Anwendung sicherer Standards auf KI-gestützte Workflows.

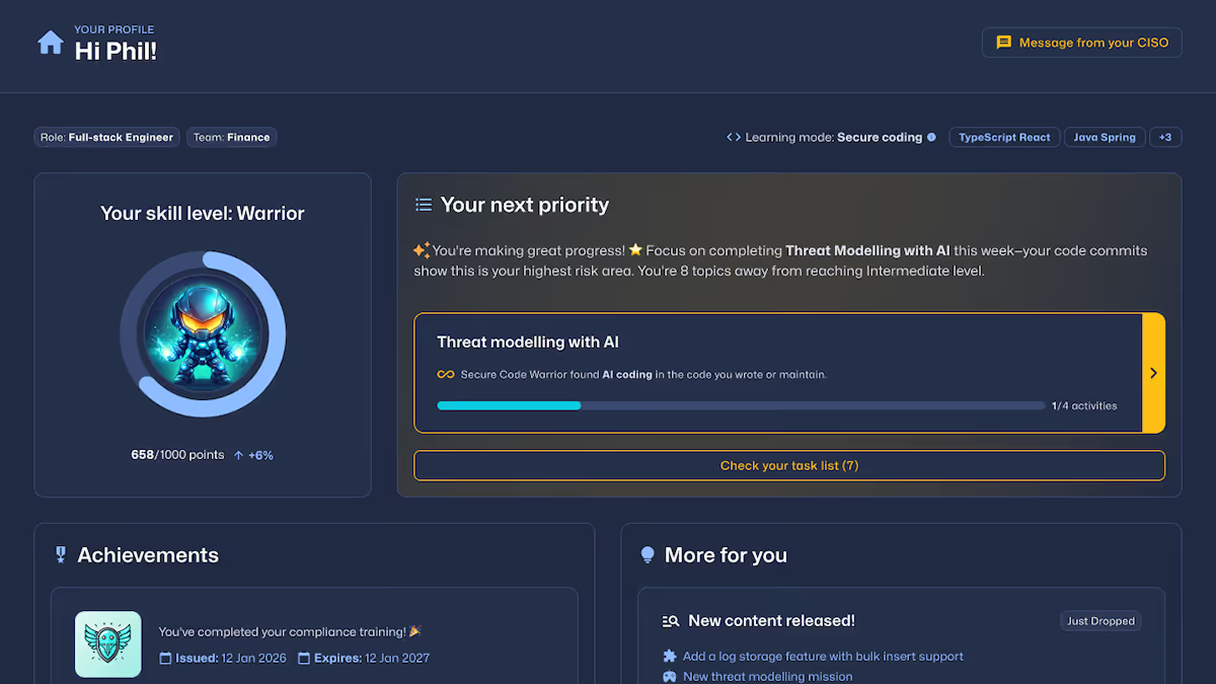

adaptiver Lernpfad

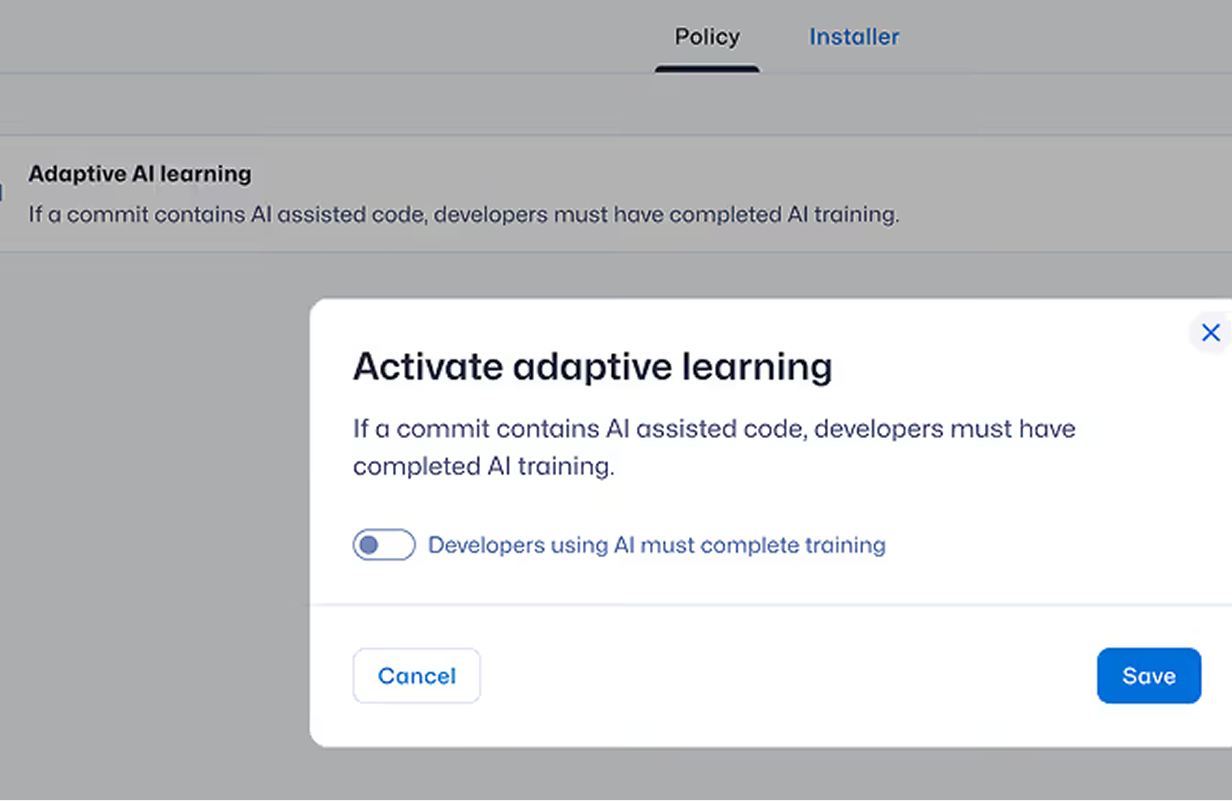

Basierend auf dem Verhalten der Entwickler, den Commit-Risikosignalen und den Benchmark-Lücken werden automatisch gezielte Schulungen zugewiesen.

Fortschritt messen

Mit SCW Trust Score® können Sie die Kompetenz Ihrer Entwickler bewerten, Benchmarks mit anderen Unternehmen der Branche durchführen und messbare Fortschritte im Bereich sicheres Codieren verfolgen.

Compliance erreichen

Sie können Berichte für Audits erstellen und Schulungen an die OWASP Top 10, NIST, PCI DSS, CRA und NIS2 anpassen.

KI-gesteuerte Entwicklung der Steuerungsebene

KI-gesteuerte Entwicklung wird sichtbar gemacht, sicher und widerstandsfähig gestaltet, Schwachstellen werden vor der Inbetriebnahme verhindert, sodass Teams schnell und selbstbewusst handeln können.

Quests

Kodierlaboratorien

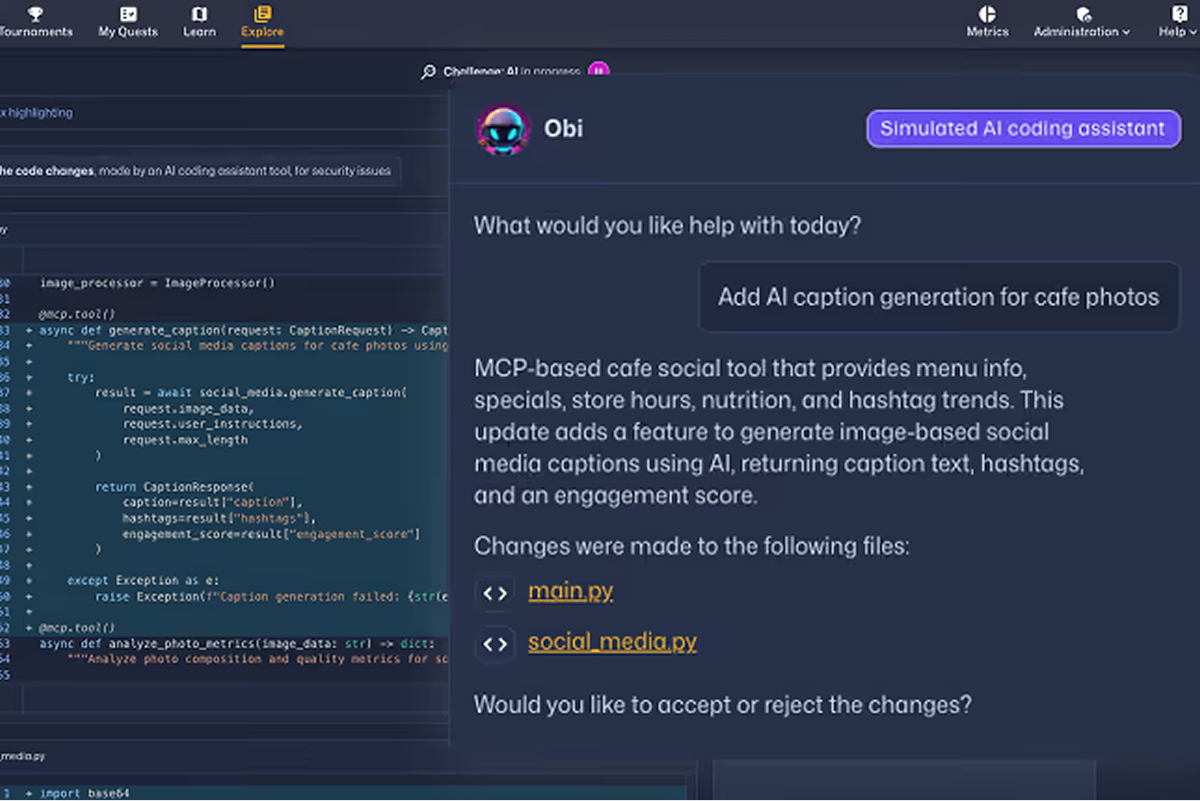

AI-Herausforderungen

Check out the SCW Learning Content Guide which outlines the breadth and depth of training available across the Secure Code Warrior platform, including secure coding vulnerabilities, AI security topics, programming languages, frameworks, and role-based learning paths.

Missions

Schwachstellen an der Quelle reduzieren

Secure Code Warrior reduziert wiederkehrende Schwachstellen, stärkt sichere Programmiergewohnheiten und ermöglicht es Entwicklern, messbare Verbesserungen nachzuweisen. Diese Ergebnisse zeigen die messbaren Auswirkungen, die sich aus der großflächigen Durchführung von Schulungen zum Thema sicheres Programmieren in modernen Entwicklungsumgebungen ergeben.

改善する時間

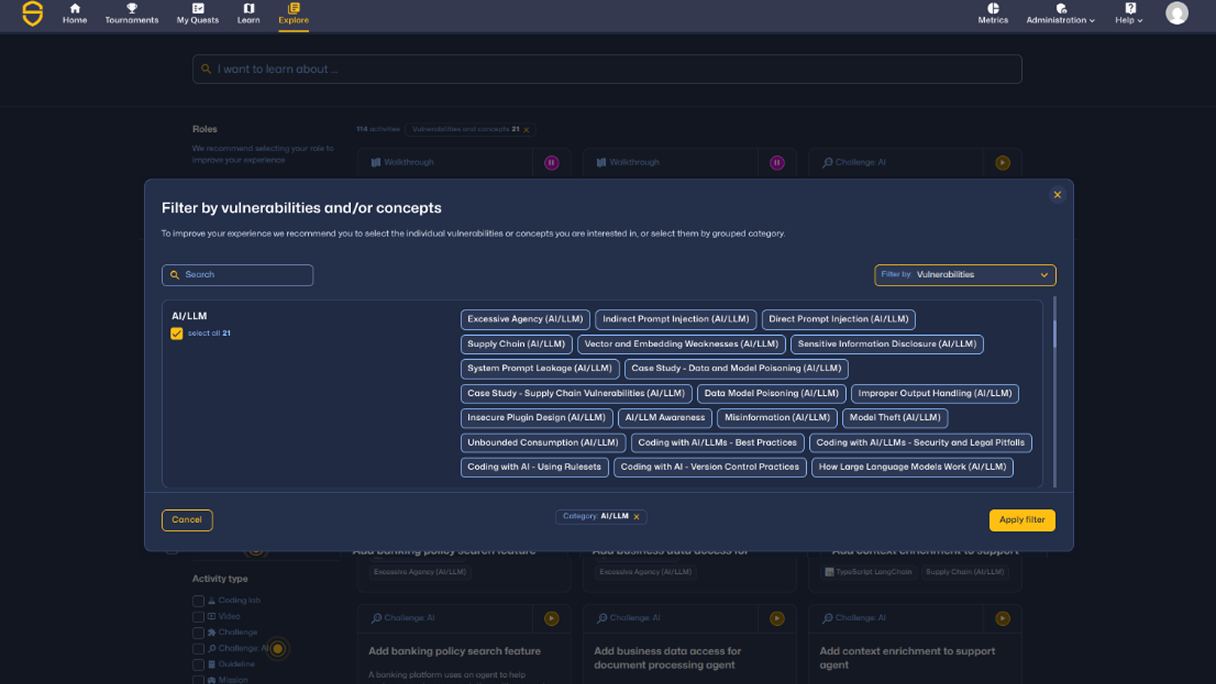

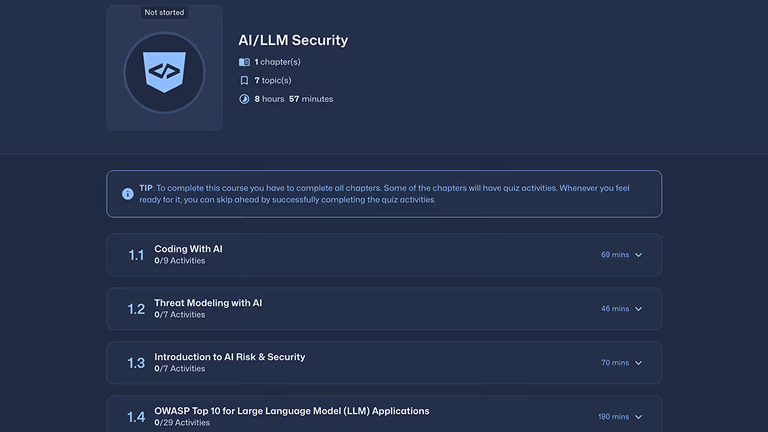

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

AI Governance Team Design

Nachweisbare Entwicklerkompetenzen werden demonstriert, wodurch Software-Risiken in der Personalentwicklung und bei der KI-gestützten Entwicklung reduziert werden.

Sicherer Code beginnt mit sicheren Entwicklern.

Stärken Sie Ihre Fähigkeiten im Bereich sicheres Codieren, reduzieren Sie die Anzahl der eingeführten Schwachstellen und bauen Sie messbares Vertrauen in Entwickler innerhalb Ihrer gesamten Organisation auf.

Reduzierung von Schwachstellen durch praktisches Lernen sicherer Programmierung

Erfahren Sie, wie Secure Code Warrior die Sicherheitsfähigkeiten von Entwicklern verbessert, Schwachstellen reduziert und messbare Risikominderungen erzielt.