KI mag Code schreiben, aber Geschick sichert ihn.

Unsere sichere Codierungsplattform für Unternehmen vermittelt die Fähigkeiten, die erforderlich sind, um sowohl von Menschen als auch von KI generierten Code zu sichern, ohne die Bereitstellung zu verlangsamen.

KI beschleunigt den Code. Fähigkeiten zum sicheren Programmieren müssen Schritt halten.

KI-Codierungsassistenten können in Sekundenschnelle produktionsreifen Code generieren. Geschwindigkeit ist jedoch nicht gleich Sicherheit.

Traditionelle Sicherheitsschulungen konzentrieren sich auf — keine Fähigkeit. Statisches Scannen erkennt Probleme, nachdem sie aufgetreten sind. Um das Softwarerisiko zu reduzieren, muss das sichere Codierungsverhalten verbessert werden Sichere Codierungsfunktionen sind die Grundlage für eine effektive KI-Software-Governance.

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

Bauen Sie in großem Maßstab sichere Codierungskompetenz auf

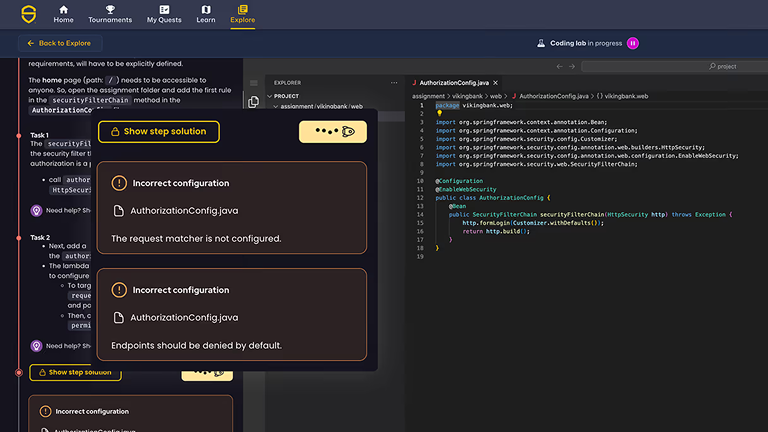

Praktische Labore für sicheres Programmieren

Entwickler lösen echte Sicherheitslücken durch interaktive Übungen in über 75 Sprachen und Frameworks.

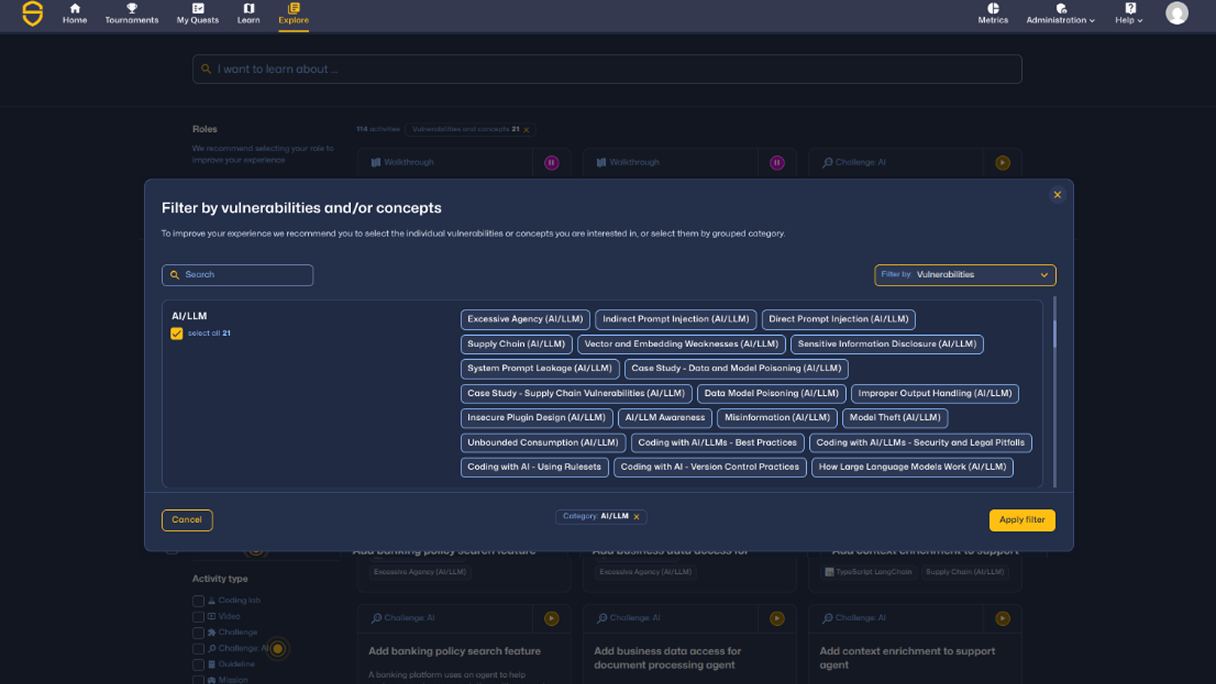

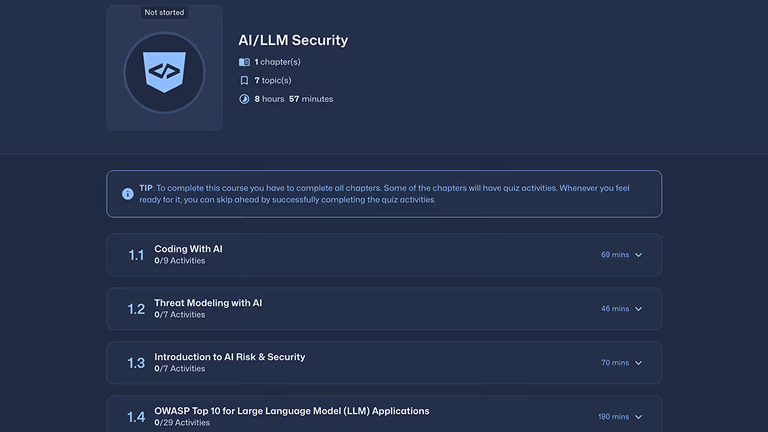

KI-spezifische Sicherheitsmodule

Validieren und sichern Sie KI-generierten Code, erkennen Sie unsichere Muster und wenden Sie sichere Standards in KI-gestützten Workflows an.

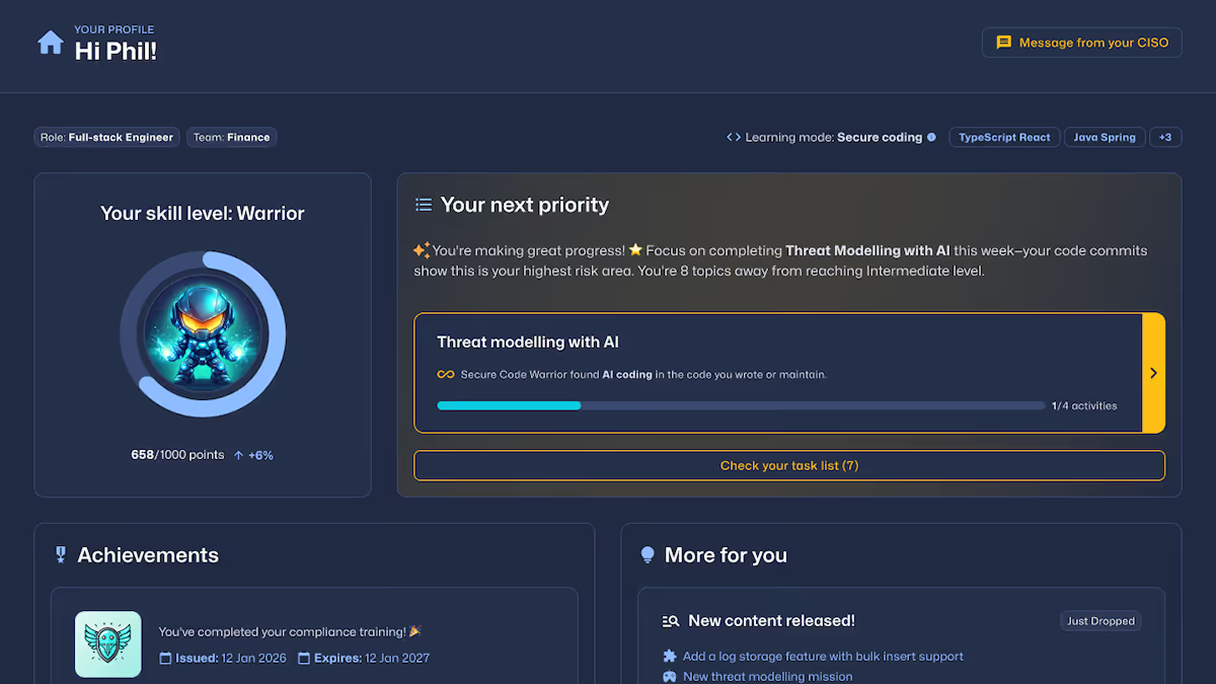

Adaptive Lernpfade

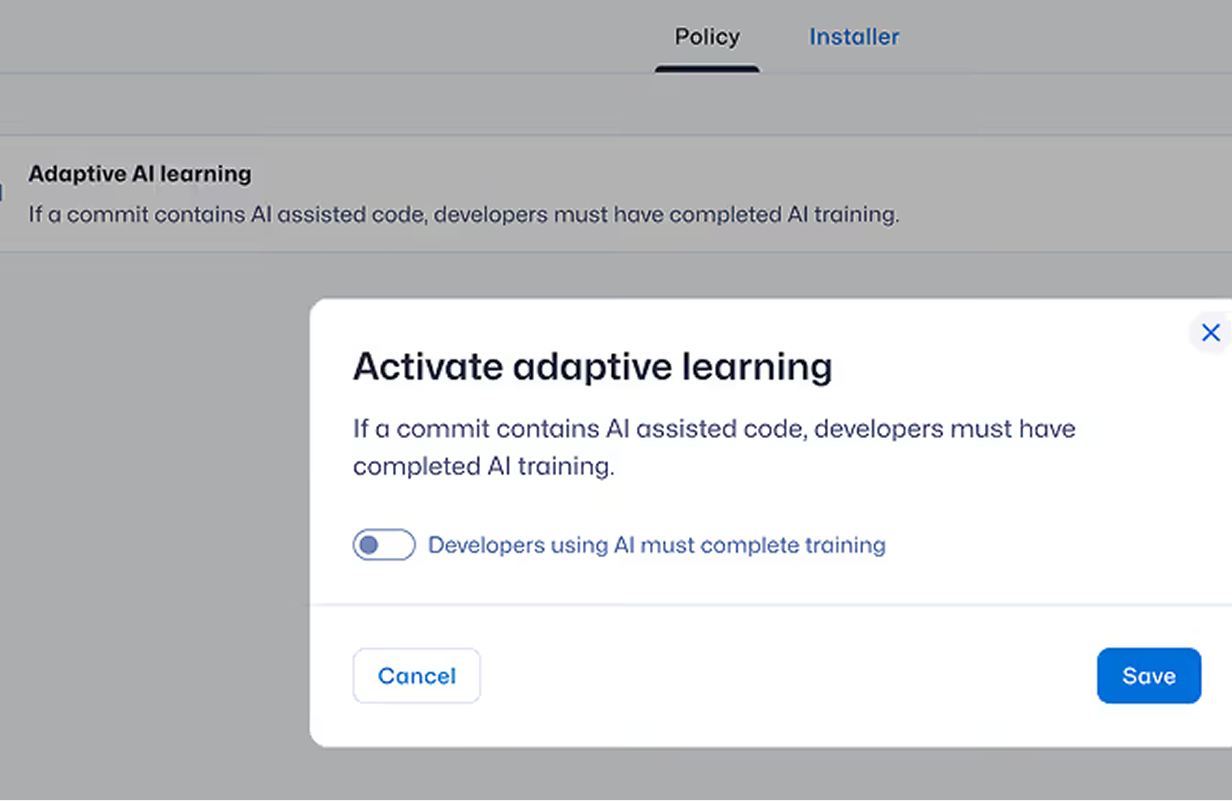

Ordnen Sie automatisch gezielte Schulungen zu, die auf dem Verhalten der Entwickler, Risikosignalen oder Benchmark-Lücken basieren.

Fortschritt messen

Beurteilen Sie die Fähigkeiten von Entwicklern, vergleichen Sie sie mit Kollegen und verfolgen Sie messbare Fortschritte bei der sicheren Codierung mit dem SCW Trust Score®.

Einhaltung von Vorschriften erreichen

Passen Sie die Schulungen an OWASP Top 10, NIST, PCI DSS, CRA und NIS2 an und bieten Sie prüfungsfähige Berichte.

Die Steuerungsebene für KI-gestützte Entwicklung

Machen Sie die KI-gestützte Entwicklung sichtbar, sicher und widerstandsfähig und verhindern Sie Sicherheitslücken schon vor der Produktion, damit Teams schnell und mit Zuversicht handeln können.

Quests

Kodierlaboratorien

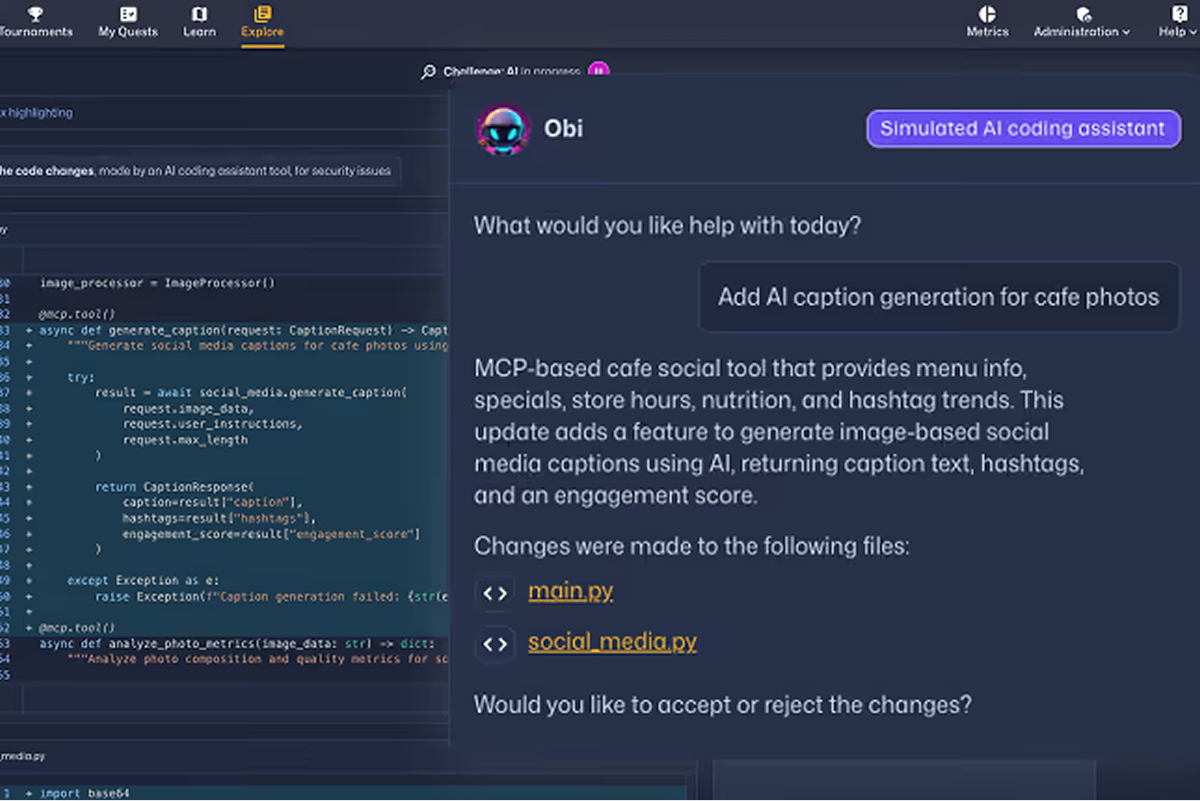

AI-Herausforderungen

Check out the SCW Learning Content Guide which outlines the breadth and depth of training available across the Secure Code Warrior platform, including secure coding vulnerabilities, AI security topics, programming languages, frameworks, and role-based learning paths.

Missions

Reduzieren Sie Sicherheitslücken an der Quelle

Secure Code Warrior Learning reduziert wiederkehrende Sicherheitslücken, stärkt sichere Programmiergewohnheiten und zeigt messbare Verbesserungen für Entwickler. Diese Ergebnisse belegen die messbaren Auswirkungen von Schulungen zum sicheren Programmieren in Unternehmen in großem Maßstab in modernen Entwicklungsumgebungen.

Zeit für die Sanierung

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

Speziell für KI-Governance-Teams entwickelt

Demonstrieren Sie messbare Entwicklerkompetenz und reduzieren Sie das Softwarerisiko bei der menschlichen und KI-gestützten Entwicklung.

Sicherer Code beginnt mit sicheren Entwicklern

Stärken Sie Ihre Fähigkeiten im Bereich sicheres Programmieren, reduzieren Sie eingeführte Sicherheitslücken und bauen Sie messbares Vertrauen der Entwickler in Ihrem gesamten Unternehmen auf.

Reduzieren Sie Sicherheitslücken durch praktisches Lernen zum sicheren Programmieren

Erfahren Sie, wie Secure Code Warrior die Sicherheitsfähigkeiten von Entwicklern verbessert, Sicherheitslücken reduziert und messbare Risikominderung bietet.